Унитазы в стиле хай-тек

Унитазы в стиле хай-тек

Казалось бы, какая связь между унитазами и чипами памяти, которые из-за глобального ИИ-бума оказались в жутком дефиците? Самая прямая, если ты Toto, крупнейший производитель сантехники в Японии. Toto выпускает вошлеты — крышки для унитаза с биде, подогревом и рядом других функций. А еще компания создает электростатические держатели, которые используются при изготовлении чипов NAND-памяти (вид флеш-памяти, хранит данные, даже если она не подключена к источнику питания, широко используется в SSD-накопителях). Керамика Toto способна выдерживать очень низкие температуры, что позволяет надежно держать кремниевые пластины при производстве чипов. Это делает материал важным для криогенного травления, причем спрос на эту технологию, как ожидается, вырастет из-за усложнения структуры чипов памяти, пишет Financial Times.

Из традиционного лидера сантехники на японском рынке Toto незаметно превратился в «растущую движущую силу в области высокотехнологичной керамики для производства полупроводников», отмечает британская инвесткомпания Palliser Capital. По версии последней, это «самый недооцененный и незамеченный бенефициар памяти для ИИ». Palliser считает, что у Toto есть преимущество с форой в пять лет, прежде чем конкуренты смогут ее догнать.

Ситуация с Toto красноречиво характеризует беспрецедентность того, с чем столкнулась вся IT-индустрия, вынужденная лихорадочно искать нестандартные решения в условиях колоссальной нехватки чипов и растущих цен на используемую в их производстве память.

Предпосылки кризиса

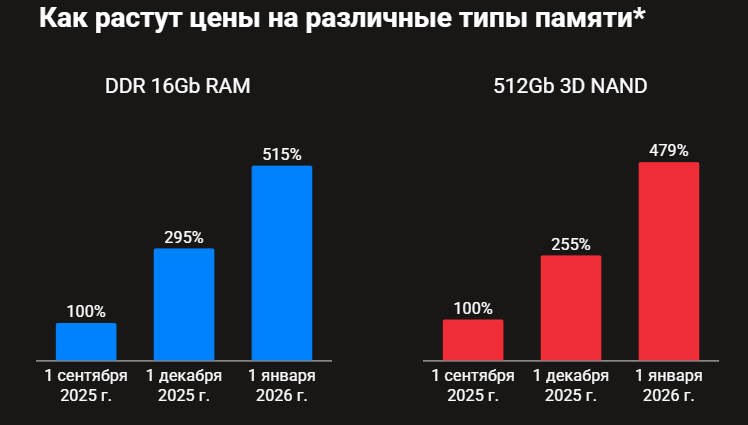

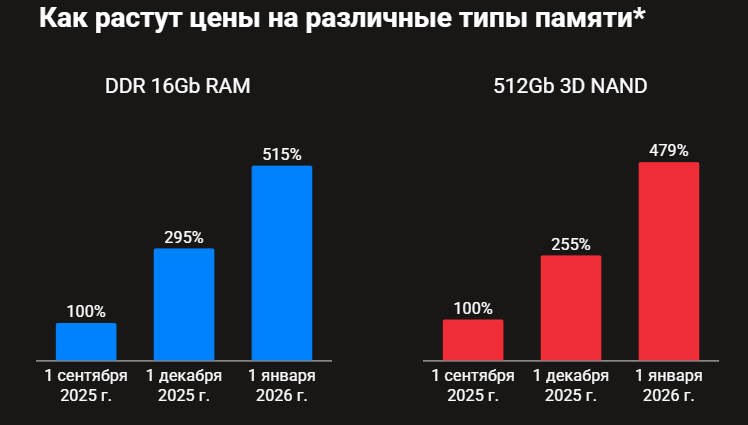

«Еще в сентябре 2025 года средняя цена на 16-гигабитный чип памяти DDR5, по данным DRAMeXchange, составляла $6,84. Три месяца спустя она выросла до $26,4, то есть почти в четыре раза. Розничные цены на модули памяти для потребительских компьютеров увеличились пропорционально: если в сентябре популярный набор на 32 ГБ памяти стоил в российской рознице менее 10 000 рублей, то к концу года его цена составляла 45 000 рублей», — писал в январской колонке для Forbes партнер Capital Lab Евгений Шатов.

Ситуация с тех пор только усугубляется, сетуют участники рынка. «Ключевой фактор конца 2025 года — стремительный рост цен на память. На плашки памяти, на диски — 170-200%», — оценивает топ-менеджер крупной российской IT-компании. Ажиотаж начался примерно с середины 2025 года, говорит генеральный директор Beeline Cloud Андрей Зотов. Рост цен на чипы памяти за 2025 год составил около 300%, и еще на 50% цены выросли уже в январе этого года, указывает генеральный директор хостинг-провайдера RUVDS Никита Цаплин.

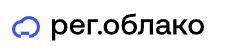

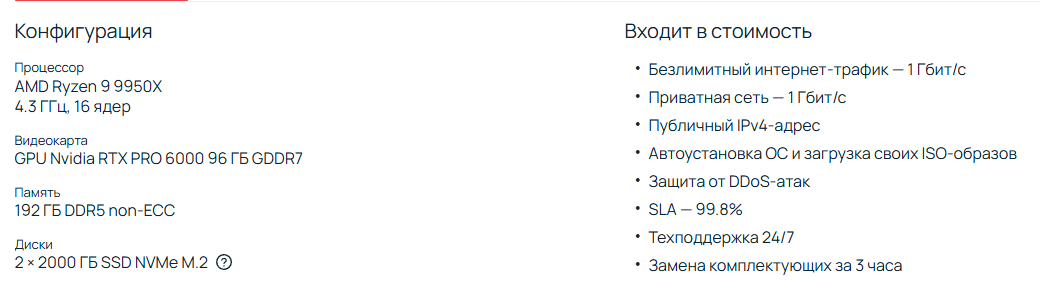

Нехватка микросхем памяти, которые используются при производстве любой электроники, от потребительской до серверной, срывает планы компаний по всему миру, завышает цены на мобильные устройства, поставки которых, в свою очередь, ожидает падение в этом году. «По нашим наблюдениям, новая серверная память с августа подорожала кратно — до семи раз, SSD (Solid State Drive, ключевой компонент смартфонов и ноутбуков) в среднем в три-четыре раза», — делится наблюдениями коммерческий директор «Рег.облака» Сергей Рыжков.

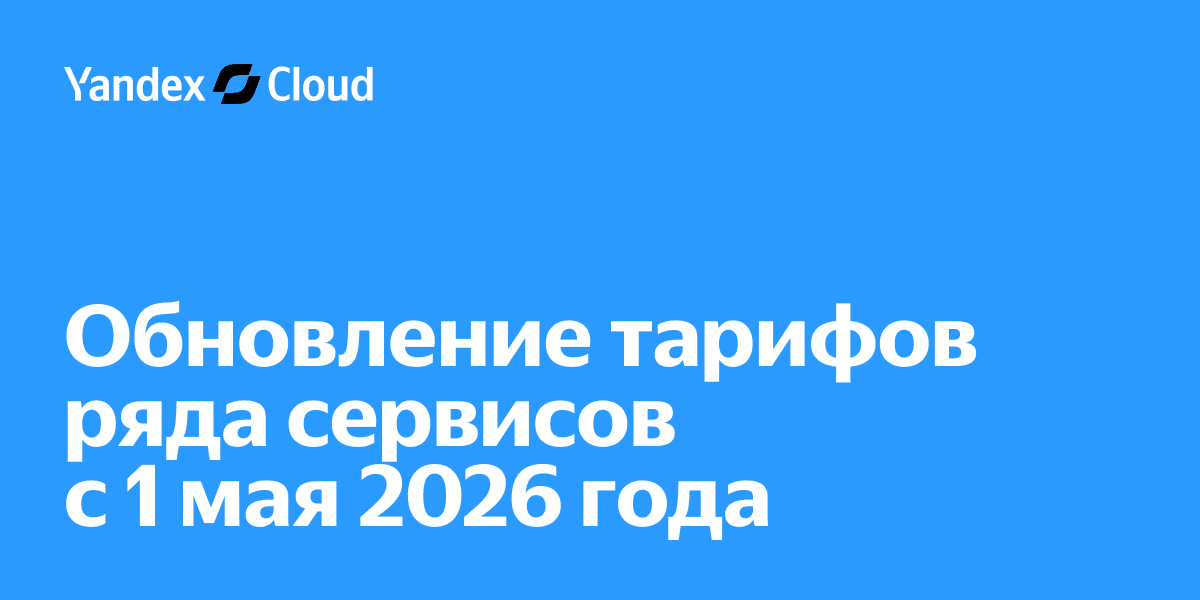

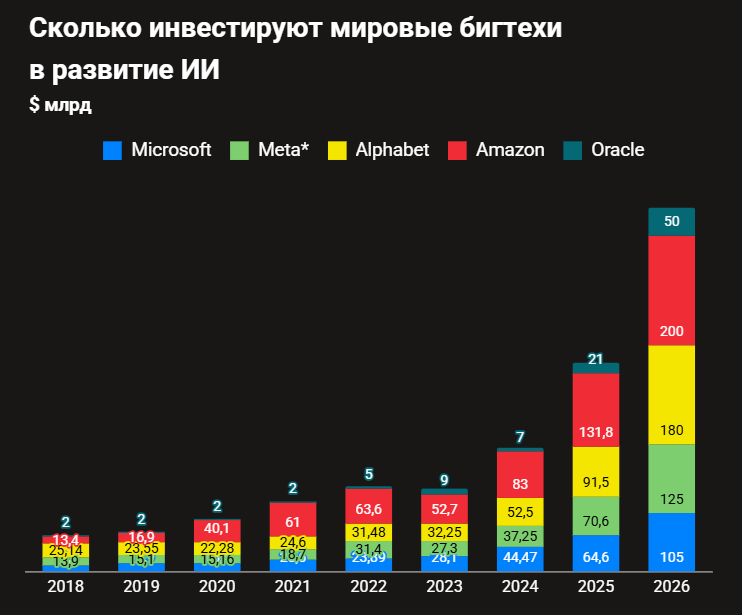

Ключевая причина резкого роста цен на чипы оперативной памяти — в распространении нейросетей и строительстве мировыми бигтехами ЦОДов для развития ИИ. «Они требуют много памяти для полной загрузки всех параметров. Если часть параметров останется на диске вне оперативной памяти, скорость обучения или работы (инференса) модели снизится на несколько порядков. Чипы оперативной памяти идут как в серверы, так и на GPU (графические ускорители), — поясняет архитектор решений виртуализации облачного провайдера Nubes Евгений Литовка. — Следом идет вторая проблема: данные для обучения надо где-то собирать и хранить, а также как-то обрабатывать. Это влечет подорожание хранения как HDD- (Hard Disk Drive, жесткий диск), так и SSD-накопителей».

Производители — Samsung, SK Hynix и Micron — массово переключили свои производственные линии на выпуск HBM (High Bandwidth Memory, память с высокой пропускной способностью), которая критически важна для ИИ-ускорителей. В сентябре 2025 года все эти компании сообщили своим клиентам о повышении контрактных цен на чипы памяти и флеш-память. «Производство HBM в три-пять раз прибыльнее, чем выпуск стандартной DRAM (Dynamic Random Access Memory, динамическая оперативная память)», — поясняет директор по ИИ «Группы Астра» Станислав Ежов. Ситуацию, добавляет он, усугубляют гиперскейлеры — крупные облачные провайдеры типа Amazon AWS, Microsoft Azure, Google Cloud, которые бронируют объемы поставок HBM на годы вперед, создавая дефицит на открытом рынке.

Изменения не коснулись только тех, кто имел долгосрочные контракты и квоты на эти чипы и их производные (крупные зарубежные IT-компании, сотрудничающие с производителями напрямую), поясняет директор AI-вертикали Selectel Александр Тугов. Речь о бигтехах — OpenAI, Google, Microsoft, Amazon, Meta (признана в России экстремистской и запрещена). Они скупают до 70% мощностей по высокоскоростной памяти, чтобы переориентировать производство с потребительских сегментов, подтверждает заместитель генерального директора Astra Cloud Константин Анисимов.

«В целом это выглядит так: память подорожала в разы, потому что огромное количество еще не произведенной памяти было куплено (законтрактовано впрок) на пока не заработанные/не полученные деньги для установки в GPU, которые тоже еще не произведены, чтобы установить их в дата‑центрах, которые еще не построены, чтобы удовлетворить потенциальный спрос, который должен вырасти по экспоненте для получения будущей прибыли когда‑то потом», — выстраивает Андрей Зотов цепочку факторов, которые привели к дефициту.

Семена дефицита на российской почве

В итоге на рынке сложились условия для «идеального шторма» — резкий рост спроса при сокращении предложения. Локальной специфики нет, все страны примерно в равных условиях, и Россия тут не исключение. «Стоимость этих категорий оборудования выросла одинаково для всего мира: дефицит конкретно в текущей точке времени глобального масштаба», — рассуждает топ-менеджер российской IT-компании. В случае с Россией ситуация осложняется еще удлинением цепочек поставок оборудования, говорят в Cloud.ru: «Локализованные производства серверов и компонентов в России недостаточны для покрытия внутреннего спроса. Хотя доля отечественных компонентов растет, значительная часть зависит от импорта».

Одно из последствий текущего кризиса в том, что бизнес пытается закупать и использовать более дешевое и простое оборудование. Там, где это возможно, компании рассматривают переход на оборудование предыдущих поколений, включая DDR4, либо б/у решения, говорит Сергей Рыжков. Но проблема в том, что оно тоже все подорожало на сопоставимые величины, разводит руками топ-менеджер крупной IT-компании. «И это скорее тактическая мера. Складские запасы постепенно иссякают. При этом физического производства NAND-чипов и соответствующих технологий в России нет, поэтому говорить о полноценном импортозамещении в этой части не приходится — компонентная база остается зависимой от внешних поставок», — добавляет Рыжков.

По словам участников рынка и экспертов IT-отрасли, такой беспрецедентный дефицит дает «волновой эффект» подорожания во всех сегментах. «От on-premise, когда все ресурсы, включая оборудование и данные, находятся внутри компании, на ее собственных серверах, до облаков, где тарифы в России уже выросли на 5-15% в среднем и до 30-40% — по премиум-конфигурациям. И они продолжат расти минимум на 10-15% в 2026 году», — считает Константин Анисимов.

«Для нас в большей степени актуальна динамика цен не на отдельные комплектующие, а на конкретные серверные сборки, — замечают в Cloud.ru. — Так, цена на серверы в стандартных, наиболее востребованных конфигурациях по итогам 2025 года выросла минимум на 30%. Показатели роста на 170-200% — это пиковые значения по отдельным позициям. Например, сильный рост цен касается специфических SKU, используемых в серверных платформах нового поколения, ориентированных на HPC (High-Performance Computing, высокопроизводительные вычисления) и AI».

Подорожание чипов памяти отразится на всем отечественном IT-рынке — изменения затронут как поставщиков и их покупателей, так и рядовых пользователей тех или иных сервисов, категоричен Никита Цаплин. Логика тут простая, полагает он: поставщик будет компенсировать издержки за счет увеличения отпускной цены на свои товары, и то же самое будет вынужден сделать и, к примеру, игрок облачного рынка. «В итоге цена увеличится по всей цепочке», — заключает Цаплин.

Облака растут на горизонте

По общему мнению экспертов, рост цен прежде всего скажется на клиентах, которые используют on-premise оборудование. Кроме того, в числе первых, как полагает Константин Анисимов, пострадают внутренние корпоративные проекты: «В них затраты на вычислительную инфраструктуру являются основными».

Однако есть и те, кто, похоже, от этого дефицита может выиграть, по крайней мере, в среднесрочной перспективе — мировой дефицит памяти может послужить новым витком и стимулом для роста бизнеса облачных игроков. «Крупные участники рынка обладают запасом ресурсной емкости, дают своим клиентам возможность переложить капитальные затраты в операционные, а также обеспечить эффективное управление ресурсами за счет возможности гибко расширять или сокращать необходимые мощности и оплачивать ресурсы по факту потребления, — считает коммерческий директор Т1 Георгий Джабиев. — Сейчас даже консервативные клиенты будут задумываться о переходе в облако или построении гибридной архитектуры».

Облачные провайдеры пока опираются на ранее сформированные запасы, но они у всех разные. Уже сейчас проекты, рассчитываемые по новым ценам, становятся дороже в 1,5-3 раза, оценивает Рыжков: «По мере исчерпания складских резервов корректировки будут неизбежны». Действительно, облачные провайдеры имеют возможность сдерживать цены за счет существующего парка оборудования, рассуждает Анисимов. «Вендоры «железа» будут вынуждены напрямую переложить увеличение цены в цену для клиента. Облачные игроки в более выгодном положении, просто потому, что уже есть большой парк, закупленный ранее, — за счет этого можно в каком-то виде сдержать рост цен, — согласен с Анисимовым топ-менеджер крупной IT-компании. — On-рremise в этом смысле радикальнее подорожает, нежели сервисы облачных игроков».

Сейчас почти весь облачный рынок выжидает и смотрит, как будет развиваться ситуация. «У всех уже согласованные бюджеты в абсолютных цифрах, и они банально смогут купить на ту же сумму денег меньше серверов, — рассуждает собеседник Forbes. — Все будут действовать осторожно. Но в ближайшие месяцы коррекция рынка здесь должна произойти». По его мнению, в числе первых, кто в рамках своей юнит-экономики это «переварить не смогут» и будут вынуждены корректировать цены, станут малые компании (уровня хостеров). В целом участники рынка выражаются в духе «массово повышать цены не планируем, но точечные корректировки возможны». Кто-то уже отреагировал: среди тех, кто повысил цены на разные услуги в диапазоне 10-15%, к примеру, Selectel, VK, Reg.ru, FirstVDS.

При этом зачастую речь идет не столько о повышении цен на уже действующие сервисы, сколько о пересмотре ранее выданных коммерческих предложений, настаивает Сергей Рыжков. «КП, подготовленные месяц-два назад, в ряде случаев становятся экономически нерелевантными. Заказчики к кратным изменениям стоимости не готовы, и часть проектов пересматривается или откладывается, активность снижается», — резюмирует он.

«Мы видим значимый рост цен на чипы памяти и другие инфраструктурные компоненты — это объективно влияет на себестоимость вычислительных мощностей и, как следствие, на весь облачный рынок, — говорит операционный директор Yandex Cloud Александр Черников. — На фоне этого закономерно увеличивается интерес клиентов к фиксации предсказуемых условий в рамках долгосрочных контрактов». По его словам, рост цен на компоненты еще не стабилизировался на какой-то отметке, поэтому «мы внимательно следим за рынком и не исключаем корректировки цен по отдельным направлениям в течение года».

Это не все последствия дефицита памяти. Как указывают аналитики, для малых компаний это действительно может стать серьезным вызовом в силу отсутствия резервов и запаса прочности. «У них будет выбор: либо повышать цены, что повлечет за собой потерю клиентов, либо, например, интегрироваться с крупными игроками», — говорит Джабиев, допуская, что облачный рынок ждет консолидация. Такое резкое подорожание ключевых компонентов IT-инфраструктуры в среднесрочной перспективе может привести к тому, что на облачном рынке останутся три-пять ключевых игроков, которые будут занимать 80-90% от его объема, считает он.

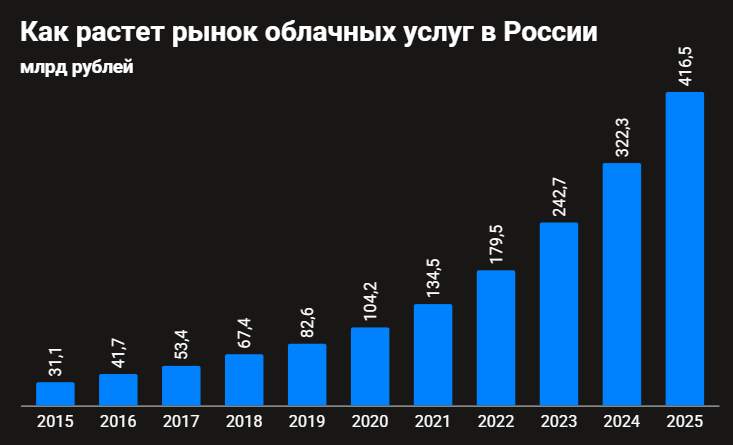

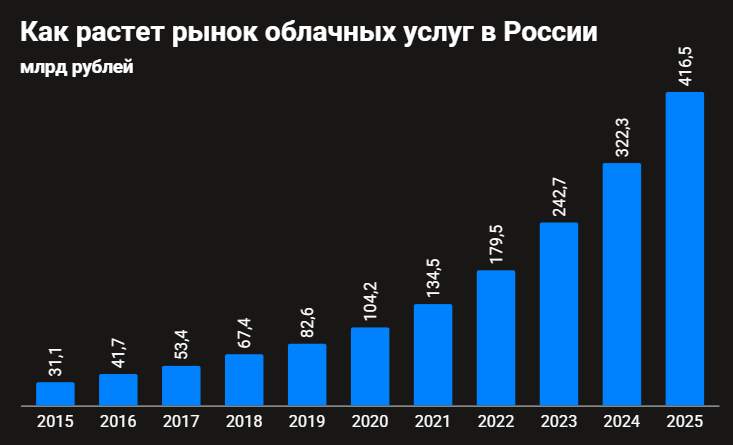

Как ранее оценивали аналитики iKS-Consulting, объем российского рынка облачных инфраструктурных сервисов в 2025 году мог вырасти на 29,2%, до 416,5 млрд рублей, а к 2030-му он может и вовсе достичь отметки 1,2 трлн рублей.

Эпоха нестабильности

Высокий спрос на чипы памяти Александр Тугов называет новой нормой. Это не разовый всплеск, добавляет он: «Это похоже на системное повышение нормы спроса под влиянием постоянно растущего уровня проникновения AI в экономики стран. В том числе — в экономику России. Отечественные компании уже активно переходят от экспериментов с AI к промышленному внедрению в бизнес-процессы».

Сложность в том, что срок эффекта всплеска цен на память непонятен, сетуют участники рынка. «На какое время он с нами: на кварталы, на годы? Будет ли нормализация — расширятся ли производственные линии? Пока мало кто хочет расширять, значит, быстро кризис не разрешится. Вдобавок, если расширять — это все равно вопрос пары лет до запуска точно», — считает топ-менеджер крупной IT-компании. Вендорам чипов выгоднее поднять цену отгрузки, чем инвестировать в новую производственную линию, замечает Евгений Литовка, — это «классический «рынок продавца».

Локализация производства серверов в России растет (доля отечественных серверов / систем хранения данных к концу 2025 года — около одной трети), но и она критически зависит от импортных компонентов, так что статус отечественного сервера не сдержит эту продукцию от роста цены, размышляет Константин Анисимов: «Срок дефицита неясен. Прогнозы — кварталы минимум без стабилизации в ближайшие месяцы, так как быстро нарастить производство столь высокотехнологичной продукции нереально».

То, что происходит сейчас, — это не предел, происходит следующая волна повышения цен, в рамках которой рост может составить около 70-90% от настоящего момента, прогнозирует Георгий Джабиев. Но даже если рост цен стабилизируется, рынку потребуется около полугода для адаптации к новой реальности, поясняет Рыжков. Если удорожание продолжится, это может привести, по его мнению, к существенному торможению проектной активности: «Пока признаков устойчивой стабилизации нет».