Топ-5 выделенных серверов Ryzen/EPYC - арендуй в Европе на ABCD.HOST

Опубликовали новый короткий разбор в блоге ABCD.HOST — подборку актуальных выделенных серверов на AMD Ryzen и AMD EPYC доступных к аренде в локациях Европы.

Собрали разные варианты: от быстрых Ryzen под сайты, API, игровые серверы и backend до мощных EPYC под виртуализацию, Docker/Kubernetes, базы данных, high-load и private cloud.

Топ 5 актуальных выделенных серверов в Европе на AMD

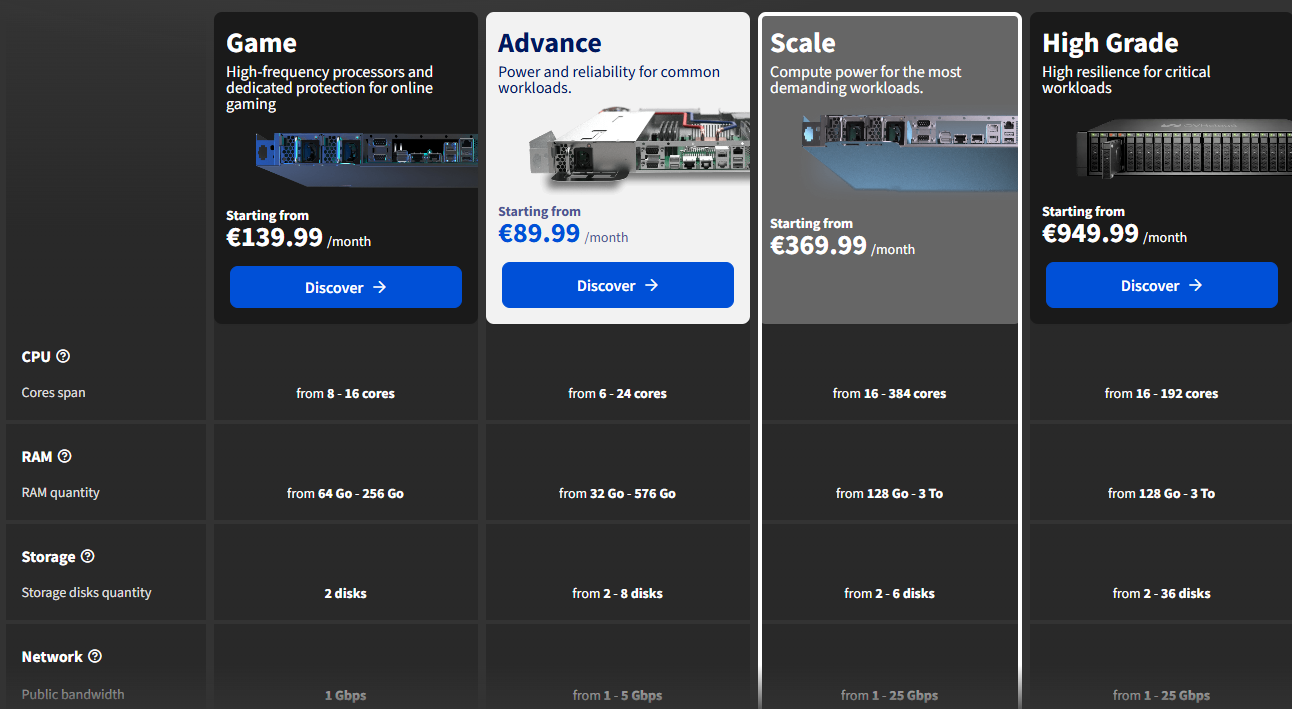

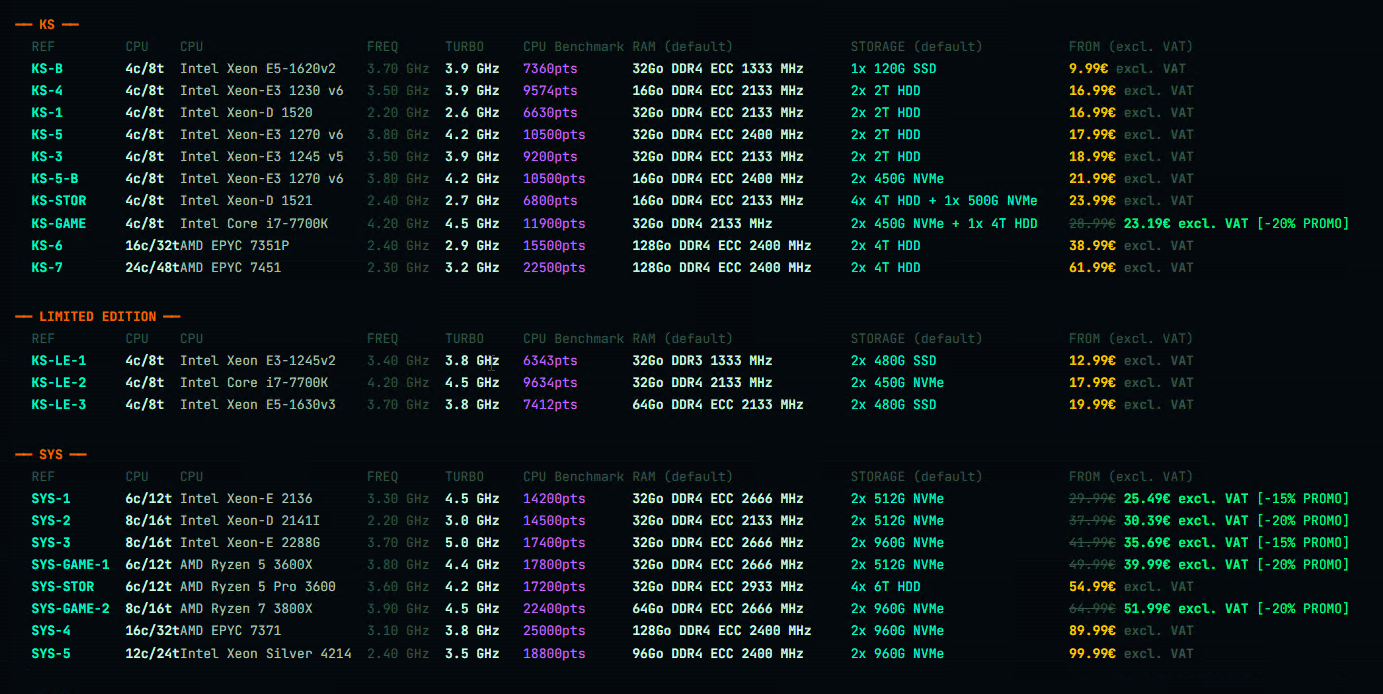

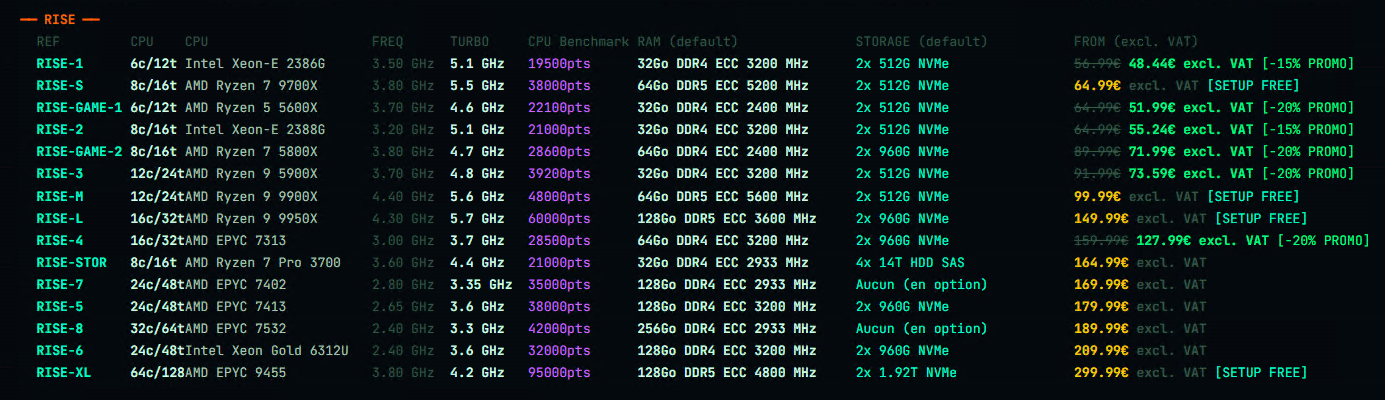

- Rise-L — Ryzen 9 9950X, 16c/32t, 128 GB DDR5 ECC, 2×960 GB NVMe — €240/мес ≈ 21 100 ₽/мес

- Rise-M — Ryzen 9 9900X, 12c/24t, 64 GB DDR5 ECC, 2×512 GB NVMe — €160/мес ≈ 14 100 ₽/мес

- SA-128 — EPYC 7502P, 32c/64t, 128 GB DDR4 ECC, 2×1.92 TB NVMe — €223/мес ≈ 19 600 ₽/мес

- AX162-S — EPYC 9454P, 48c/96t, 128 GB DDR5 ECC, 2×3.84 TB NVMe — €367/мес ≈ 32 300 ₽/мес

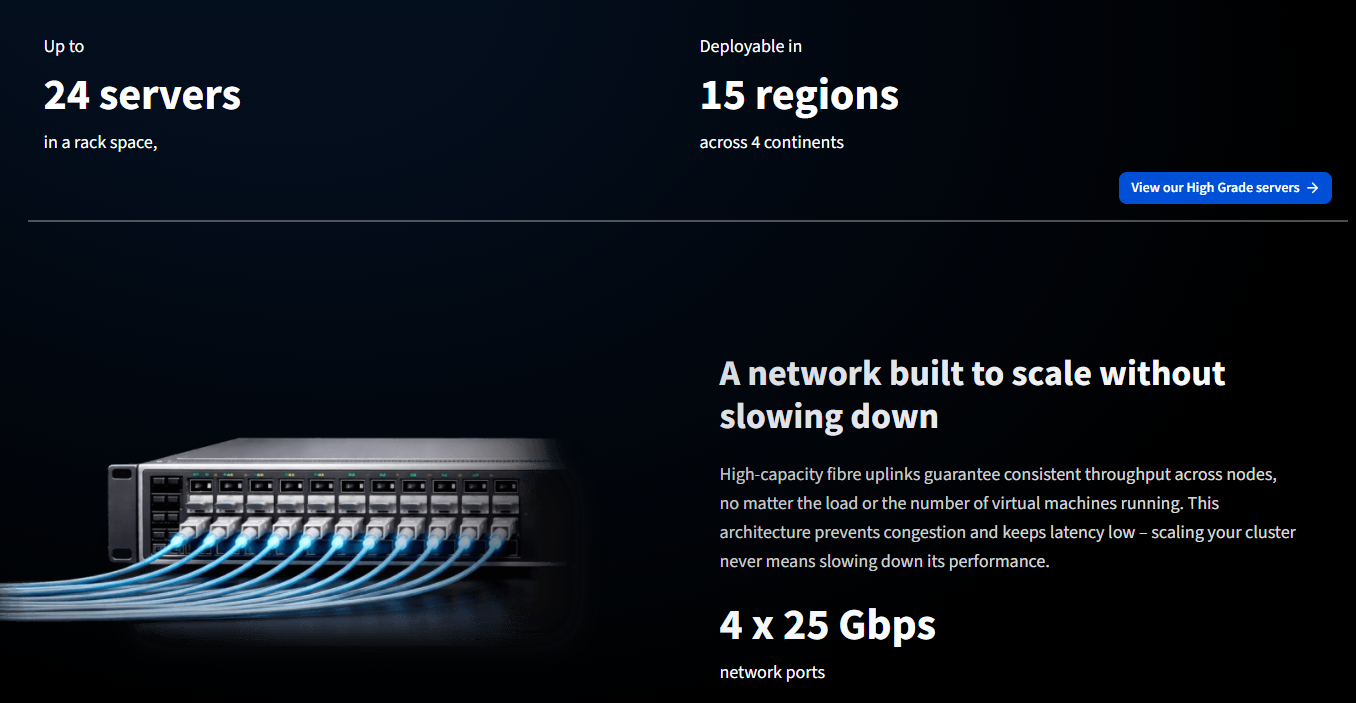

- SCALE-a8 — EPYC TURIN 9965, 192c/384t, 128 GB DDR5 ECC, 2×1.92 TB NVMe, 5 Gbps — €1440/мес ≈ 126 700 ₽/мес

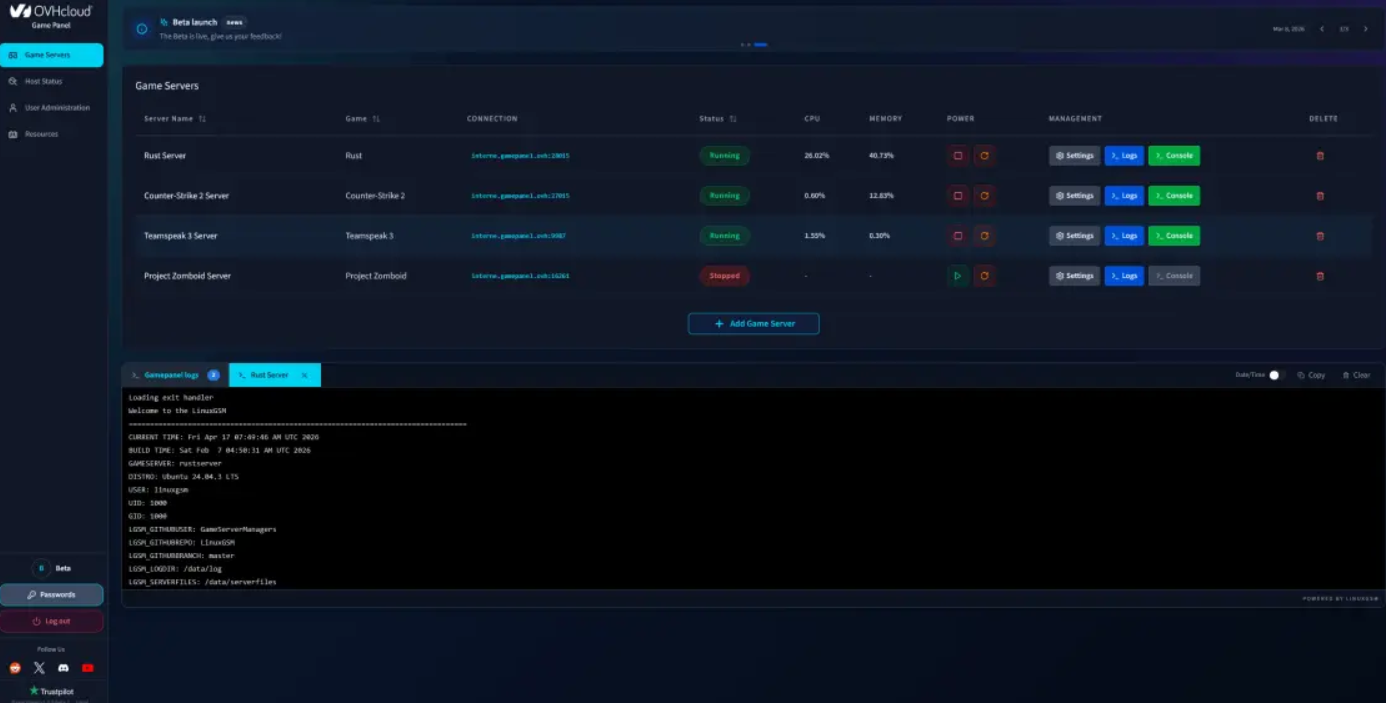

Ryzen — когда важна высокая частота на ядро: сайты, API, игры, backend, CI/CD.

EPYC — когда нужны ядра, потоки и стабильная многопоточная нагрузка: виртуализация, контейнеры, базы данных, private cloud.

Полный разбор с описанием сценариев использования:

blog.abcd.host/abcd-host-bare-metal-radar-top-5-vydelennyh-serverov-ryzen-epyc/

Актуальные выделенные серверы можно посмотреть и заказать здесь:

abcd.host/dedicated

Если нужно подобрать конфигурацию под конкретную задачу — напишите нам в поддержку, подскажем по Ryzen/EPYC под вашу нагрузку.

Спасибо, что остаетесь с нами!

ABCD.HOST