Компания OVHcloud расширяет ассортимент своих решений для оборонных компаний в Европе и набирает сотрудников для удовлетворения растущего спроса

Рубе – 31 марта 2026 г. – Компания OVHcloud, европейский лидер в области облачных технологий, объявила на форуме InCyber 2026 об ускорении своей деятельности в европейском оборонном секторе. Этот импульс обусловлен ускоренной цифровизацией вооруженных сил и их сохраняющейся зависимостью от неевропейских технологий. Уже сотрудничая с оборонными подрядчиками, группа ускоряет свой рост в Европе, предлагая облачные решения и решения на основе искусственного интеллекта для критически важных сред, а также привлекает экспертов из вооруженных сил и оборонной промышленности.

Облачные технологии, данные, ИИ: структурирование рынка, европейская альтернатива.

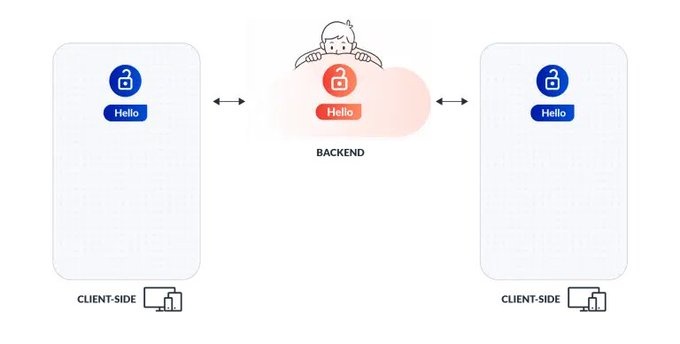

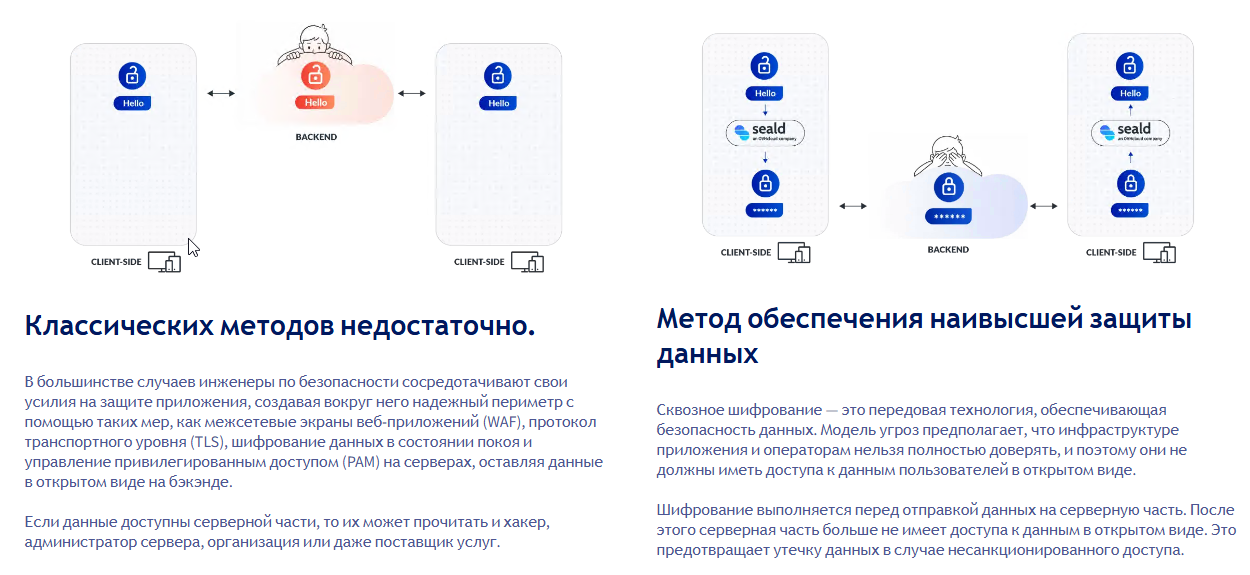

Европейские вооруженные силы сталкиваются с быстрой трансформацией: цифровизация операций, обработка данных в реальном времени, взаимосвязь систем и развитие ИИ. Соответственно, меняются и требования: контроль данных, отказоустойчивость, повышенная кибербезопасность и соответствие национальным и европейским стандартам. Рынок быстро развивается, движимый этими новыми областями применения. Сегодня он по-прежнему в значительной степени доминируется неевропейскими игроками. В этом контексте вопросы суверенитета и стратегической автономии становятся центральными. OVHcloud использует свое полное владение технологической цепочкой для удовлетворения требований самых чувствительных сред.

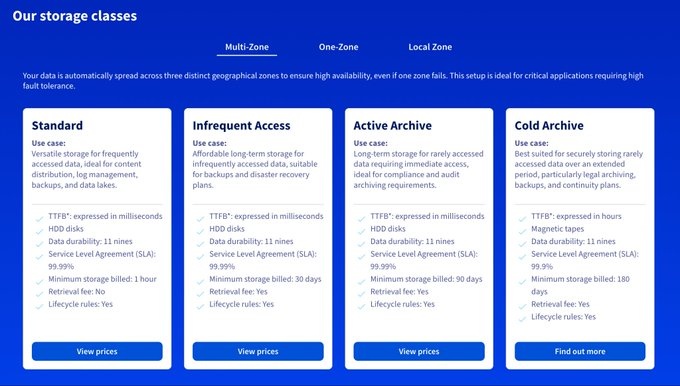

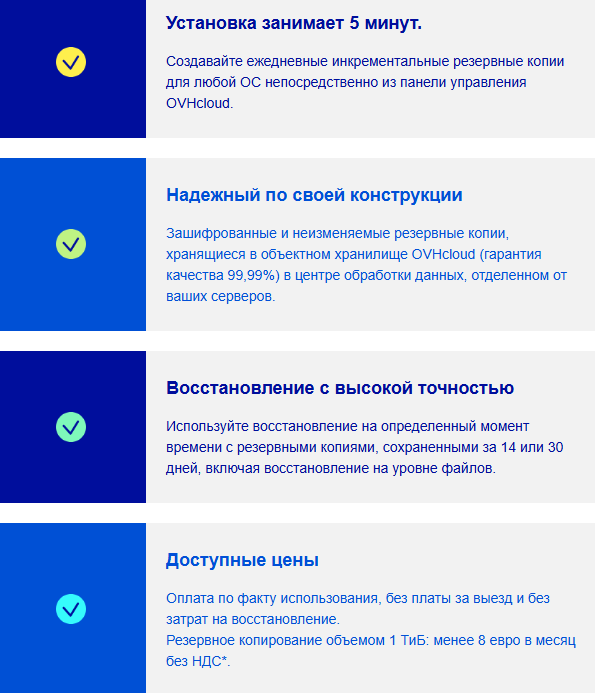

Компания OVHcloud уже несколько лет оказывает поддержку предприятиям оборонного сектора, и ее решения уже внедрены в критически важных средах. Группа опирается на крупномасштабную облачную инфраструктуру с многолокальными архитектурами и регионами 3-AZ, обеспечивающими непрерывность бизнеса и отказоустойчивость. Ее решения соответствуют высоким стандартам безопасности и соответствия требованиям, включая SecNumCloud. Предлагаемое ею аппаратное и программное обеспечение, в частности OPCP, позволяет развертывать облачные платформы непосредственно в центрах обработки данных клиентов, от базовой инфраструктуры до наиболее важных объектов на периферии, с высоким уровнем контроля и управляемости. Такой комплексный подход отвечает текущим потребностям: доступ к передовым облачным и ИИ-возможностям при сохранении контроля над инфраструктурой, данными и операциями.

OVHcloud расширяет свои решения по всей Европе, используя свои внутренние ресурсы и развертывая специализированные команды в каждой стране, привлекая персонал из вооруженных сил и оборонной промышленности. Группа также поддерживает профессиональное развитие своих команд для соответствия национальным требованиям, особенно в отношении допусков к секретной информации и сертификатов (включая те, которые классифицируются как «оборонная тайна»). Эти команды будут отвечать за: разработку индивидуальных архитектур, поддержку модернизации инфраструктуры, интеграцию возможностей ИИ (тонкая настройка, агентные вычисления) и решение специфических задач каждой среды.

Оборона сегодня зависит от облачных технологий, данных и искусственного интеллекта. В нынешних условиях Европа больше не может позволить себе полагаться на неевропейские технологии: ей необходимы высокоэффективные и суверенные альтернативы. Именно это мы и создаем в OVHcloud. После Франции мы будем предлагать облачные решения и решения на основе ИИ по всей Европе, а также экспертные знания, способные поддержать трансформацию вооруженных сил и укрепить нашу стратегическую автономиюОктав Клаба, генеральный директор OVHcloud