Обучение модели может занимать недели и требовать суперкомпьютерных мощностей. Но ценность она создает только в один момент — когда отвечает на конкретный запрос пользователя.

Этот момент называется инференсом.

Инференс ИИ (от англ. inference — логический вывод) — это практическое применение навыков искусственного интеллекта, которые он усвоил в ходе обучения. Когда умная колонка включает свет по вашей просьбе или смартфон с помощью Face ID распознает лицо для разблокировки экрана — это и есть инференс модели в действии. Во всех подобных случаях локальное устройство или удаленный сервер выполняет операцию логического вывода.

Говоря языком определений, инференс — это процесс, при котором уже готовая, натренированная нейросеть получает новые входные данные, выполняет математическое вычисление, опираясь на каждый свой внутренний параметр, и выдает готовый результат. В этот момент обработка данных происходит «на лету», без изменения исходного кода или архитектуры алгоритма.

Инференс модели: как он связан с обучением

Невозможно запустить инференс, если предварительно не создать обученную модель.

Что такое обучение модели (training)

На этом этапе дата-инженеры заставляют алгоритм искать математические связи внутри огромных наборов данных. Модель выдает свой ответ, сравнивает его с правильным ответом, фиксирует ошибку и самостоятельно корректирует свои внутренние веса (параметры). Этот цикл повторяется миллионы раз, пока точность предсказаний не достигнет необходимого уровня.

Тренировка требует вычислительной мощности. Обычно для этого используются GPU. Когда целевой процент точности достигнут, корректировки останавливаются, а веса фиксируются. Алгоритм «замораживается», превращаясь в готовый продукт.

После этого можно приступать к инференсу.

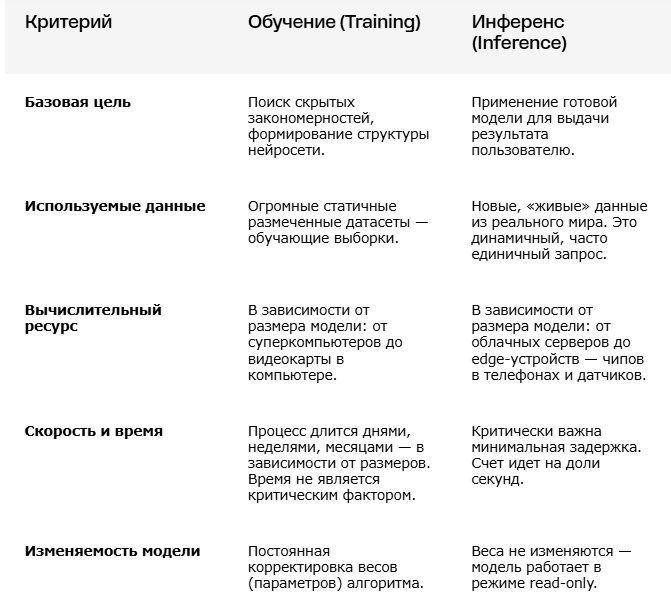

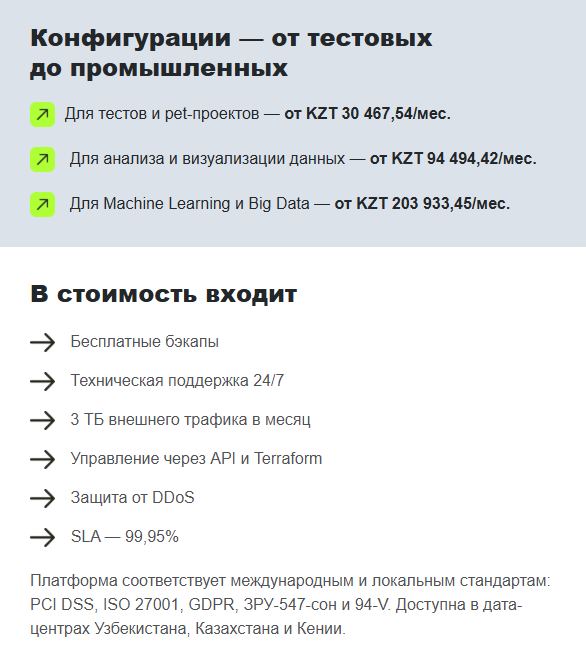

Разница инференса и обучения

Если обучение — это долгое и ресурсоемкое создание «мозга», то инференс — это эксплуатация этого «мозга» в продакшене. Эти два процесса отличаются по целям, инфраструктуре и метрикам эффективности.

Как работает инференс искусственного интеллекта

Как работает инференс искусственного интеллекта

Любая система искусственного интеллекта при обработке новых данных проходит строго определенный конвейер шагов. Скорость и точность этого процесса зависят от архитектуры обученной модели и характеристик используемого оборудования.

Принцип работы: от запроса до результата

Вне зависимости от того, генерирует ли нейросеть текст или анализирует изображение, процесс логического вывода (forward pass) включает три этапа:

- Препроцессинг (Подготовка). Пользователь отправляет запрос через интерфейс или API. Поскольку алгоритмы работают исключительно с математическими абстракциями, входная информация (слова, пиксели, аудиоволны) конвертируется в многомерные массивы чисел — тензоры.

- Прямой проход (Вычисление). Подготовленные данные проходят через слои нейросети. На этом этапе каждая математическая операция матричного умножения использует накопленные знания, чтобы преобразовать входной тензор.

- Постпроцессинг (Выдача). Финальный числовой массив декодируется обратно в понятный человеку формат. Результатом работы становится сгенерированный текст, перерисованное изображение или координаты рамки, если система должна была найти конкретный объект на видео.

Аппаратная база и требования к железу

Инференс ИИ требует специфического подхода к оборудованию. Выбор железа — это всегда поиск баланса между тем, насколько быстрый нужен ответ, и какой вычислительный ресурс экономически целесообразно выделить под задачу.

- Серверный инференс (cloud/on-premise). Выполняется на мощных серверах. Видеокарта идеально подходит для инференса благодаря тысячам вычислительных ядер, способным параллельно обрабатывать огромный массив чисел. Высокая производительная мощность помогает загрузить в память «тяжелые» модели и обслуживать сотни пользователей одновременно.

- Edge-инференс (на устройстве). Вычисления переносятся непосредственно на конечное устройство: смартфон, IoT-датчик или умную камеру. Этот подход исключает этап передачи данных на удаленный сервер. Отсутствие сетевых запросов радикально снижает общую задержку, экономит пропускную способность сети и повышает приватность. Однако локальная вычислительная мощность и размер памяти устройства жестко ограничены, что требует использования компактных, сжатых версий нейросетей.

Инференс LLM (больших языковых моделей)

Большие языковые модели (LLM, Large Language Model), такие как GPT, Llama или Claude, построены на архитектуре трансформеров. Их базовая задача — разобраться в структуре языка, векторах смыслов и научиться предсказывать следующее слово (точнее, его фрагмент — токен) на основе всего предыдущего контекста.

Что такое LLM и как они генерируют текст

В контексте текстовых нейросетей инференс LLM работает по принципу авторегрессионной генерации. То есть модель не выдает весь ответ мгновенно. Процесс выглядит так:

- Система анализирует входящий промпт и генерирует первый токен.

- Этот сгенерированный токен добавляется в конец исходного запроса.

- Модель анализирует обновленный запрос и генерирует следующий токен.

Цикл повторяется до тех пор, пока обученная модель не выдаст специальный токен остановки (stop-token) или не упрется в заложенный разработчиками лимит длины.

Особенности инференса LLM: токены, задержки и память

Главная проблема при работе с LLM — это скорость ответа и потребление оперативной памяти. В отличие от задач компьютерного зрения, где изображение обрабатывается за один проход, при генерации текста системе приходится заново прогонять данные через всю сеть для каждого нового слова.

Инженер, настраивающий инференс, всегда отслеживает два критических фактора производительности:

- TTFT (Time To First Token) — время до появления первого сгенерированного слова. Этот показатель определяет, насколько быстро система обрабатывает исходный промпт (этап prefill).

- TPOT (Time Per Output Token) — время генерации каждого последующего токена (этап decode).

Именно эта метрика определяет, с какой скоростью текст «печатается» на экране.

Чтобы не пересчитывать математические состояния предыдущих слов при генерации каждого нового токена, сервер сохраняет промежуточные результаты вычислений в специальный кэш контекста (КV-cache). У этого решения есть цена: по мере увеличения длины диалога объем, который занимает КV-cache в видеопамяти графического процессора, растет. При пиковой нагрузке видеопамять забивается кэшами прошлых запросов, поглощая свободный ресурс ускорителя и ограничивая число пользователей, которых сервис может обслуживать параллельно.

Где используется инференс (inference)

На практике инференс интегрирован в огромное количество IT-сервисов.

Компьютерное зрение

Инференс моделей компьютерного зрения работает с сетками пикселей в изображениях или видеопотоке. В отличие от языковых моделей, здесь данные обычно проходят через сверхточные сети или vision-трансформеры за один прямой проход.

- Обнаружение объектов. Камера беспилотного автомобиля непрерывно передает кадры на бортовой компьютер (edge-устройство). Инференс ИИ каждую миллисекунду определяет границы пешеходов, знаков и других машин, формируя решение о продолжении движения или торможении.

- Сегментация и классификация. Медицинские системы анализируют рентгеновские снимки, выделяя зоны с потенциальными патологиями.

Обработка естественного языка

Помимо генерации текста, инференс применяется для глубокого синтаксического и семантического анализа исходного запроса.

- Машинный перевод. Преобразование текста из одного языкового пространства в другое с учетом контекста.

- Анализ тональности и классификация. Спам-фильтры в почтовых клиентах или системы мониторинга бренда, которые за доли секунды определяют, является ли отзыв пользователя негативным или позитивным.

Рекомендательные системы

Стриминговые платформы и маркетплейсы используют инференс для персонализации выдачи. Когда пользователь заходит на главную страницу, система собирает его вектор истории поиска и прогоняет через обученную модель ранжирования. Результат работы — это отсортированный список товаров или фильмов, вероятность клика по которым математически наивысшая.

Голосовые помощники

Работа умной колонки — это каскадный инференс, состоящий из трех последовательных этапов:

- Автоматическое распознавание речи конвертирует аудиоволну в текст.

- Языковая модель анализирует текст и формирует ответ.

- Синтез речи переводит текстовый результат обратно в голосовой формат.

Эта многосоставная операция должна уложиться в минимальный промежуток времени, чтобы диалог казался естественным.

Проблемы и ограничения инференса

Перенос обученной модели из лабораторной среды в продакшен неизбежно сталкивается с аппаратными и физическими пределами. Чем умнее и точнее искусственный интеллект, тем больше в нем параметров и тем сложнее обеспечить его быстрый и бесперебойный инференс.

Нехватка видеопамяти (VRAM Wall)

Чем больше размер модели, тем больше нужно видеопамяти. А это самый дорогой и ограниченный вычислительный ресурс.

Каждый параметр нейросети занимает конкретный объем физической памяти. Например, модель ИИ на 70 миллиардов параметров (например, Llama 3 70B) только для загрузки своих «накопленных знаний» в память потребует около 140 ГБ VRAM. Дополнительная память нужна для обработки самого запроса (тот самый KV-cache).

Задержки

Задержка — это время между отправкой запроса и получением результата. В некоторых системах критичен каждый такт процессора. Сама задержка складывается из двух факторов:

- Сетевая задержка. Время передачи данных от клиента к серверу и обратно. Именно из-за этого фактора производители умных устройств стремятся перенести вычисления на Edge-уровень.

- Вычислительная задержка. Время обработки математических матриц внутри GPU. Если модель слишком «тяжелая», прямой проход занимает недопустимо долгое время.

Сложности масштабирования под нагрузкой

Обслуживание одного запроса отличается от одновременного обслуживания тысяч пользователей. Когда популярный сервис сталкивается с пиковой нагрузкой, серверы начинают ставить входящие промпты в очередь.

Чтобы оптимизировать процесс, инженеры используют динамический батчинг (batching) — группировку нескольких запросов в один пакет для параллельного вычисления на видеокарте. Однако запросы имеют разную длину и генерируют ответы разного размера. Обработка неравномерных пакетов приводит к простою вычислительной мощности: одни ядра видеопроцессора уже закончили работу, а другие еще обрабатывают длинный текст. Управление этой нагрузкой — одна из главных инженерных проблем LLM-инференса на сегодняшний день.

Оптимизация инференса

Обслуживание больших нейросетей обходится компаниям очень дорого. Чтобы снизить инфраструктурные издержки и повысить общую производительность, инженеры применяют специальные технические решения, меняющие внутреннюю структуру алгоритмов или логику обработки запроса.

Главная задача здесь — найти баланс скорости инференса и качества: сделать так, чтобы система работала быстрее и потребляла меньше ресурсов ускорителя, но при этом исходная точность не деградировала.

Квантование

Это самый популярный метод — уместить тяжелую модель в ограниченный объем VRAM. Суть подхода заключается в изменении точности чисел, описывающих параметры нейросети.

Во время обучения веса модели обычно хранятся и вычисляются в 16-битном формате с плавающей запятой (FP16/BF16), где каждое число занимает 2 байта. Также существует возможность хранить их в 32-битном формате (FP32). Квантование позволяет математически округлить эти значения до менее вместительных форматов — 8-битных или 4-битных (INT8, FP8, INT4).

В результате размер обученной модели на диске и в оперативной памяти сокращается в 2–4 раза. Уменьшенная модель требует меньше тактов на чтение информации, скорость передачи данных по шине графического процессора кратно возрастает, а качество генерации падает незначительно.

Сжатие моделей

Еще один эффективный подход — физическое упрощение архитектуры алгоритма.

- Прунинг, обрезка. После обучения в архитектуре сети остаются миллионы математических связей, вес которых близок к нулю. Они потребляют вычислительную мощность, но не влияют на итоговый результат. Инженеры выявляют такие «бесполезные» нейроны и удаляют их из графа вычислений, делая нейросеть легче и быстрее.

- Дистилляция знаний. Процесс, при котором огромная, медленная обученная модель выступает в роли «учителя». На ее идеальных ответах тренируют маленькую, компактную модель-«ученика». Меньшая модель усваивает паттерны поведения большой и может работать автономно с высокой скоростью на слабом железе.

Ускорение: устранение простоев и умный батчинг

Для текстовых LLM критически важна работа с памятью и очередями. Если обрабатывать промпты по одному, дорогостоящий вычислительный ресурс будет простаивать в ожидании новых токенов.

Чтобы избежать простоев, применяется метод непрерывного батчинга. Процесс строится динамически: система не ждет, пока графический чип допишет весь длинный текст для одного пользователя. Как только в пакете вычислений освобождается место (кто-то получил свой финальный токен), сервер тут же подмешивает туда новый запрос от другого клиента.

Чтобы оперативная память не фрагментировалась из-за разной длины ответов, кэш контекста нарезают на одинаковые страницы (блоки). Это работает аналогично управлению памятью в современных операционных системах и позволяет увеличить пропускную способность сервера в несколько раз.

Часто задаваемые вопросы (FAQ)

Что такое инференс простыми словами?

Это процесс работы уже готового (натренированного) искусственного интеллекта. Когда вы отправляете фото в приложение, чтобы наложить фильтр, или пишите вопрос в чат-бот, система применяет свои накопленные знания к вашим новым данным, чтобы мгновенно выдать результат. Выполнение этой задачи — и есть инференс.

Что такое инференс модели?

Это этап жизненного цикла модели глубокого обучения, следующий после тренировки (training). На этапе инференса внутренние параметры нейросети «заморожены». Модель не учится ничему новому, она используется исключительно в режиме чтения для выполнения предсказаний, классификации или генерации контента.

Как работает инференс LLM?

Инференс больших языковых моделей работает по принципу авторегрессии. Нейросеть генерирует ответ не целиком, а последовательно — один токен (часть слова) за другим. Каждый новый сгенерированный токен добавляется к вашему исходному контексту, и алгоритм заново оценивает весь текст, чтобы предсказать следующую часть слова, пока не дойдет до логического конца.

Можно ли запустить инференс на обычном процессоре (CPU)?

Да, можно. Процесс логического вывода на центральном процессоре отлично подходит для компактных нейросетей, небольших объемов данных и Edge-инференса. Однако вычисление тяжелых моделей (например, генерация изображений или локальный запуск LLM) на CPU будет происходить крайне медленно из-за недостатка параллельных ядер, в отличие от видеокарт (GPU).

Чем Edge-инференс отличается от облачного?

Облачный инференс работает на удаленных мощных серверах — он быстрый, но требует постоянного подключения к интернету, что создает сетевую задержку. Edge-инференс выполняется локально, прямо на вашем устройстве. Он полностью приватен, не тратит время на передачу данных по сети и работает без связи, но ограничен вычислительной мощностью чипа в устройстве.

Почему популярные чат-боты иногда печатают ответ с паузами или задержками?

Это связано с метриками TTFT (время до первого токена) и вычислительной задержкой внутри серверов компании. Если сервис находится под высокой нагрузкой от тысяч пользователей одновременно, ваш запрос встает в очередь, а мощностей GPU не хватает для мгновенной генерации текста в режиме реального времени.

Сколько памяти нужно, чтобы запустить AI на своем ПК или сервере?

Для грубого расчета используйте формулу: «Число параметров × количество байт формата точности». Если модель имеет 8 миллиардов параметров и квантована в 4-битный формат (0.5 байта на параметр), для ее базовой загрузки потребуется около 4 ГБ видеопамяти. Плюс еще 1–2 ГБ потребуется выделить для кэша контекста во время самой генерации текста.

В чем разница между инференсом и промпт-инжинирингом?

Инференс — это аппаратный и математический процесс вычисления внутри компьютера. Промпт-инжиниринг — это пользовательский навык составления правильных, точных текстовых запросов (промптов), чтобы в ходе инференса нейросеть поняла задачу максимально верно и выдала ожидаемый результат.

servercore.com