Черная пятница 2025 в is*hosting. Самое мощное предложение года!

Привет, друзья!

Мы встречаем Чёрную пятницу не просто так. В 2025 году is*hosting отмечает 21-й День рождения, и по этому случаю мы выкатили действительно редкие условия. Если вы развиваете проект, усиливаете инфраструктуру или просто давно хотели апгрейд, сейчас самое время.

Главное в этом году

50% скидка на VPS и VPN

Нормальный способ расширить мощности без лишних затрат.

- 50% на первый месяц VPS Linux Lite / VPN по промокоду VPS20BBF

- Получите +6 месяцев в подарок при оплате на год.

- Постоянная скидка 50% на тарифы VPS (кроме Lite) при заказе на 1–6 месяцев с промокодом VPS50BF

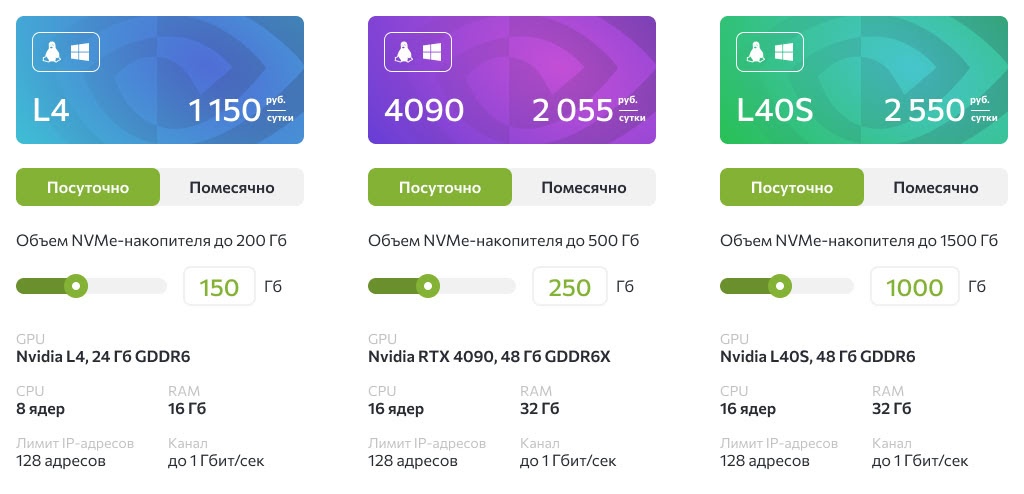

20% скидка на выделенные серверы

Если нужна серьезная мощность и стабильность:

- Промокод DS20BF действует на серверы в Нидерландах, Финляндии, России и США (конфигурации US2-xx)

- Скидка доступна на любой срок аренды. Только новые заказы.

Бонусы за пополнение баланса до 30%

Ваши деньги работают больше, чем обычно.

- От $50 до $1000 — бонус 15%.

- От $1000 до $5000 — бонус 20%.

- От $5000 до $10000 — бонус 30%.

Максимальная сумма бонуса — $3000 (и да, это реальная цифра). Важно! Чтобы получить бонус, пополните баланс и создайте тикет со словами «С Днём рождения» и секретным кодом IS*21. Бонус доступен клиентам с активной услугой и начисляется в течение 24 часов. Скидки и бонусы не суммируются. Услуги по промокодам не возвращаются (Black Friday всё же).

Когда?

С 28 ноября по 2 декабря 2025 года.

Мы работаем, чтобы вы запускали больше

21 год мы строим инфраструктуру, на которую можно опереться: стабильную, быструю, глобальную.

Спасибо, что вы с нами. Ваши проекты — лучшая часть этой истории.

Переходите на сайт и забирайте предложения, которые появляются только раз в году.

inferno.name

С любовью,

Команда is*hosting