Как вернуть доступ к российским сервисам в отпуске: пошаговая инструкция

Многие россияне за границей сталкиваются с тем, что не могут открыть приложения банков, налоговой службы, маркетплейсы и другие важные ресурсы. К счастью, это можно исправить: достаточно создать свой сервер внутри России и направить интернет-трафик через него.

В статье покажем, как быстро развернуть такой сервер на VPS, а также настроить подключение к нему со смартфона и компьютера, чтобы снова получить доступ к российским сайтам и сервисам из-за границы.

Почему блокируют заграничные IP-адреса

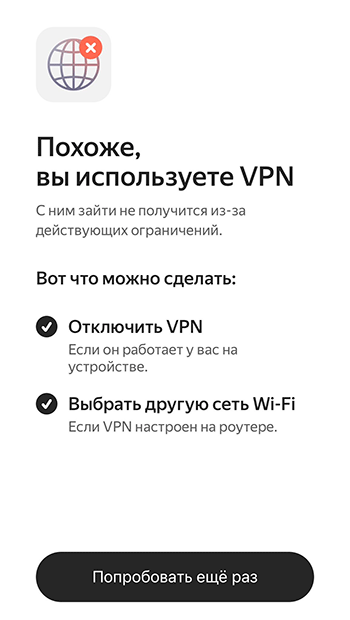

В конце марта Минцифры сообщило крупнейшим цифровым платформам, что они должны блокировать доступ пользователям с VPN, иначе лишатся места в «белых списках». К середине апреля многие популярные сайты и сервисы выполнили требование властей. Среди них «Госуслуги», Сбербанк, Ozon, Wildberries, Aviasales, сервисы «Яндекса» и РЖД. В некоторых случаях под ограничения попали все заграничные IP-адреса. Даже если человек не пользуется VPN, а просто находится за границей, он не может зайти на некоторые сайты из «белого списка». Хотя такого не планировалось, но ситуация случилась из-за «кривой» реализации указаний сверху. При заходе из-за границы доступ к некоторым сайтам блокируется с такой заглушкой:

Как сообщают туроператоры, проблемы с доступом возникают у туристов из дальнего зарубежья: Турция, Таиланд, Египет, Вьетнам. От туристов в странах СНГ жалоб не поступает. То есть из Беларуси или Казахстана всё работает нормально.

В середине апреля в сети опубликовали список сайтов, доступ к которым был недоступен с VPN и/или с заграничных IP-адресов. Вот они:

Государственные сервисы

- «Госуслуги»

- ЕМИАС

- мессенджер Max

- Мосэнергосбыт

- Маркетплейсы

- Ozon

- Wildberries

- DNS

- «Детский мир»

- «ВсеИнструменты.ру»

- Lamoda

- «Золотое яблоко»

- Банки

- Сбербанк

- Альфа-банк

- ВТБ

- Т-Банк

- «Магнит»

- «Дикси»

- «Пятёрочка»

- «Яндекс Лавка»

- «Самокат»

- «Вкусвилл»

- «Азбука вкуса»

- «Братья Караваевы»

- «Чижик»

- «Вкусно и точка»

- «Ростикс»

- Онлайн-кинотеатры

- «Кинопоиск»

- Wink

- Okko

- «Иви»

- «ВКонтакте» (VK)

- Медицина

- «Семейный доктор»

- «Медси»

- Путешествия

- РЖД

- Tutu.ru

- «Авиасейлс»

- «2ГИС»

- «Яндекс Go»

- «Ситимобил»

- BelkaCar

- Gismeteo

- «Яндекс Почта»

- «Яндекс Погода»

- «Яндекс Пэй»

- HeadHunter

- «Профи.ру»

- «Авто.ру»

В мае сообщалось, что маркетплейсы потеряли до 10% пользователей из-за блокировки VPN. Конкретно у Wildberries мобильный трафик за месяц сократился на 10%, а десктопный — на 6%.

Очевидно, эффект от блокировки отразился и на других сайтах из списка.

Чтобы решить эту проблему, Минцифры опубликовало специальную методичку, как отличать VPN-трафик от простого заграничного. Текст методички опубликовал Telegram-канал «Профсоюз работников IT».

Например, вот инструкции в методичке по распознаванию VPN на устройствах iOS:

- использовать системный API CFNetworkCopySystemProxySettings () для получения настроек текущего подключения;

- проверить, есть ли в настройках сетевые интерфейсы с именами utun, tap, tun, ppp или ipsec.

«Наличие [таких] интерфейсов… может указывать на работающий VPN», — сказано в документе.

Получается, что отдельные приложения на смартфоне пользователя (от Сбера, VK, Яндекса и др.) должны собирать признаки и определять, запущен ли на телефоне VPN.

Зачастую обойти это ограничение можно, если пробросить канал через российский VPS и заходить на сайты с российского IP-адреса. Некоторым туристам за границей такой способ может помочь. Посмотрим, как он работает.

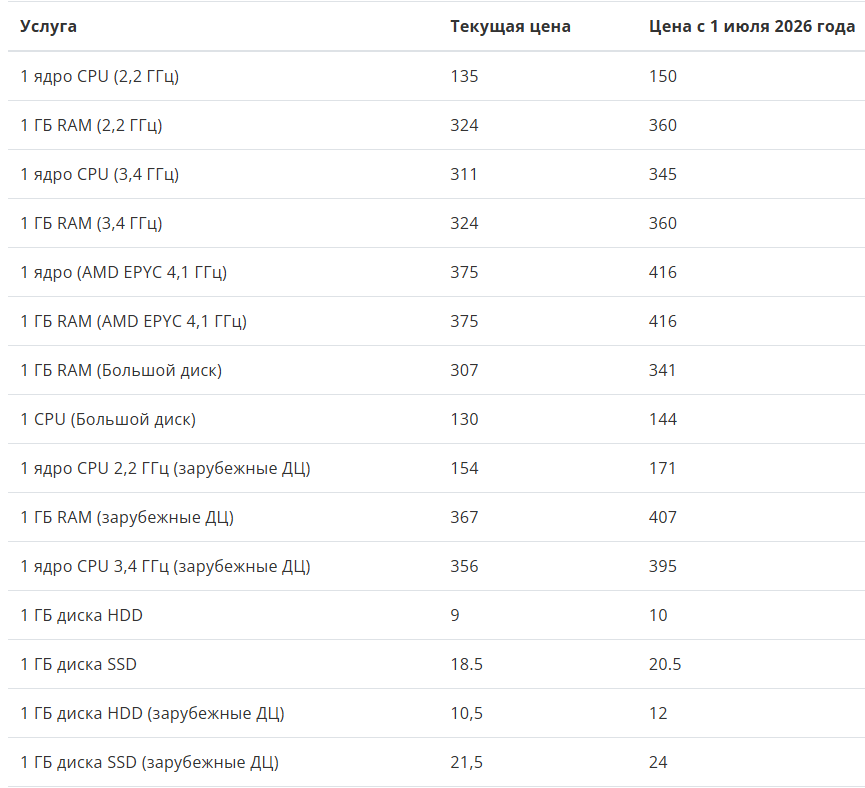

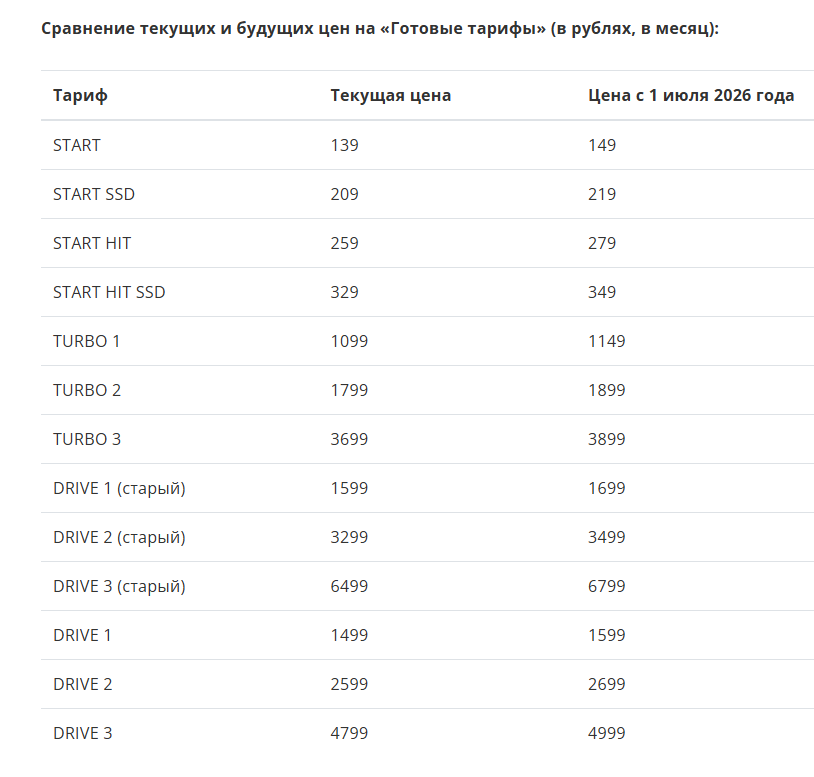

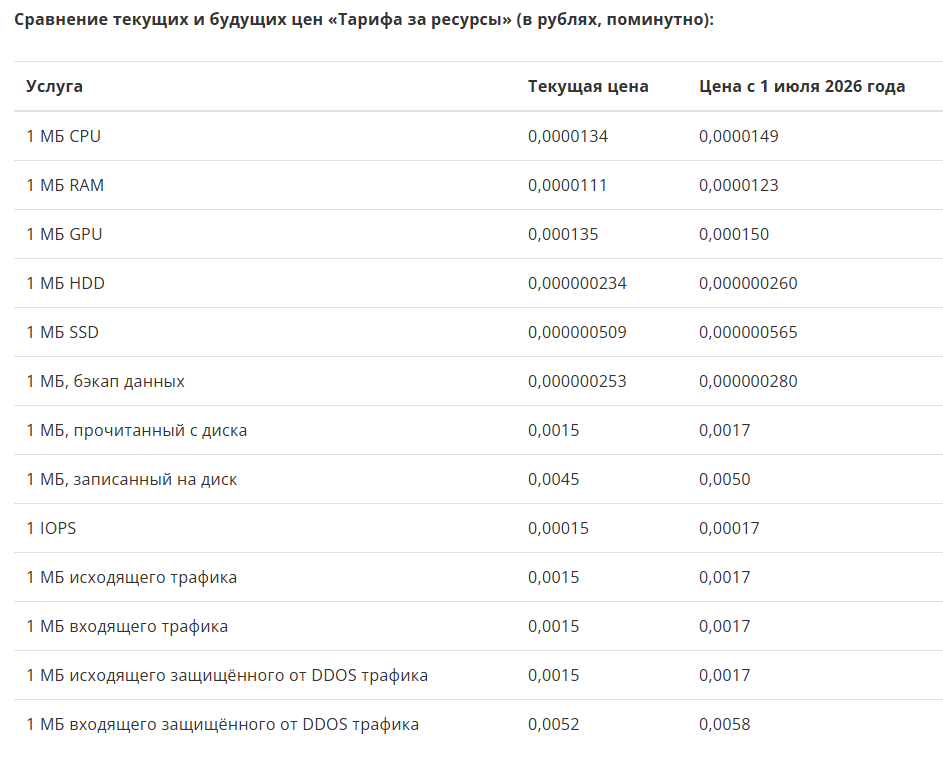

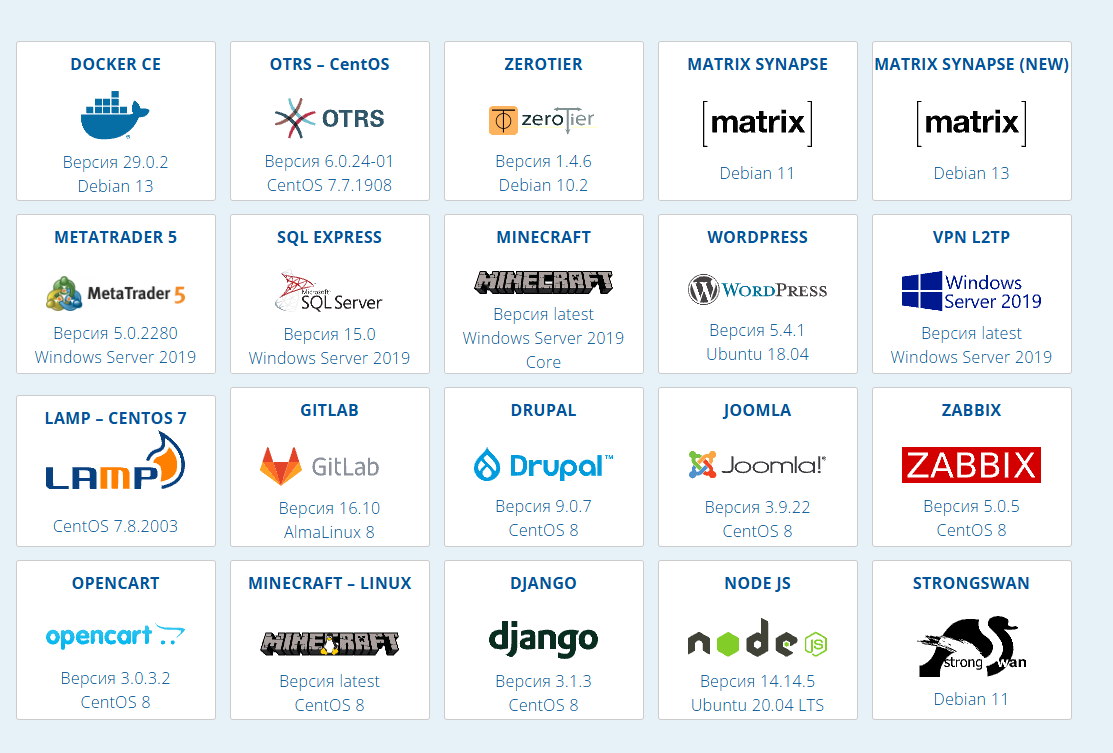

Подойдёт любой компьютер в РФ, который постоянно включён и имеет выход в интернет через местного провайдера. А если такого компьютера нет, можно арендовать виртуальный сервер в российском дата-центре и использовать его как прослойку. Для этого подходит готовый шаблон L2TP от RUVDS.

Шаблон L2TP

На маркетплейсе выбираем шаблон VPN L2TP. Это шаблон Windows Server 2019 с предустановленными ролям RRAS и NPS.

Затем выбираем расположение дата-центра (в нашем случае Россия).

Далее ставим нужные конфигурации, но для обычного пользования вполне хватит минимальных.

Оплачиваем услугу.

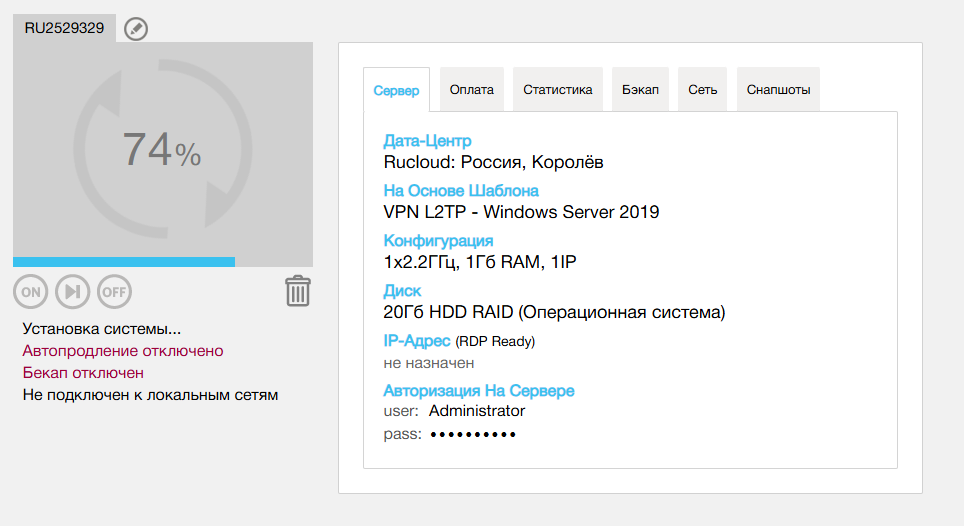

Ждём установки сервера.

Готово! Теперь у нас есть свой сервер, к которому осталось только подключиться с ПК или мобильного устройства.

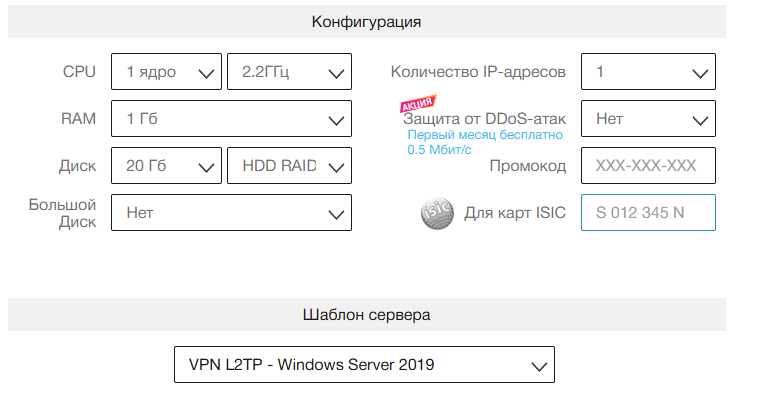

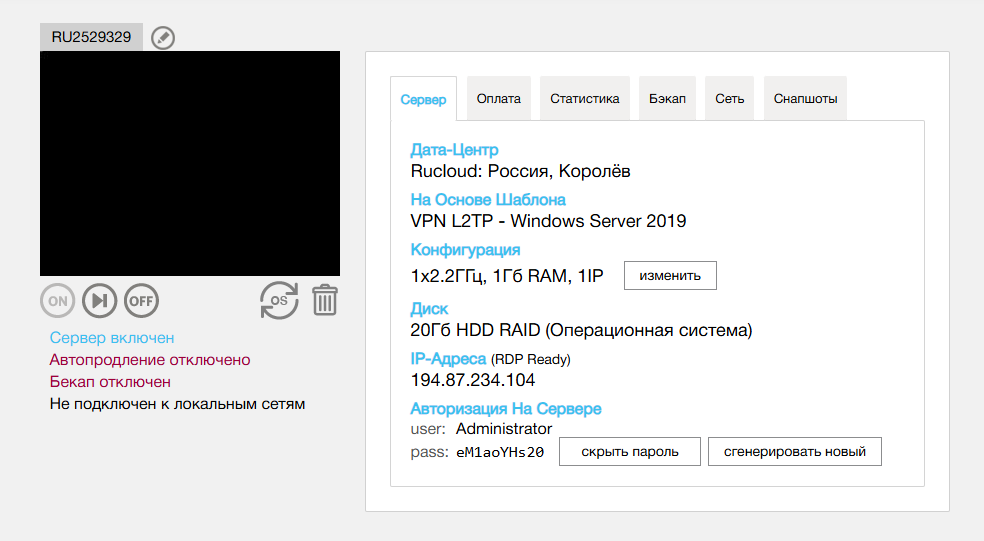

Где посмотреть данные для подключения

Чтобы подключиться к нашему серверу, нужно знать несколько параметров:

- Сервер: публичный IP-адрес нашего сервера

- Учётная запись: Administrator

- Пароль: пароль от сервера

- Общий ключ: vpn

IP-адрес и пароль можно узнать прямо в меню взаимодействия с сервером (для пароля нужно ввести пароль от учётной записи в целях безопасности).

Вот как это должно выглядеть:

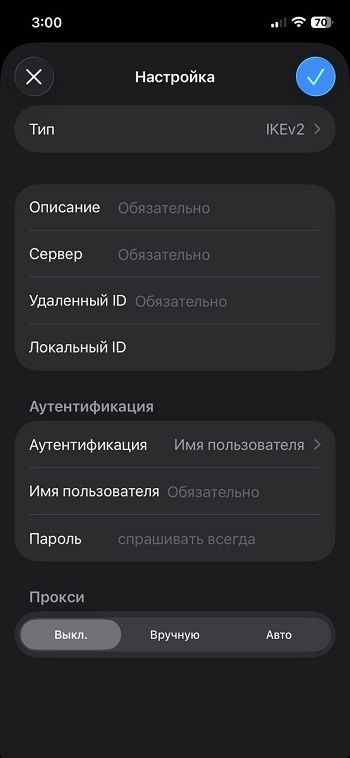

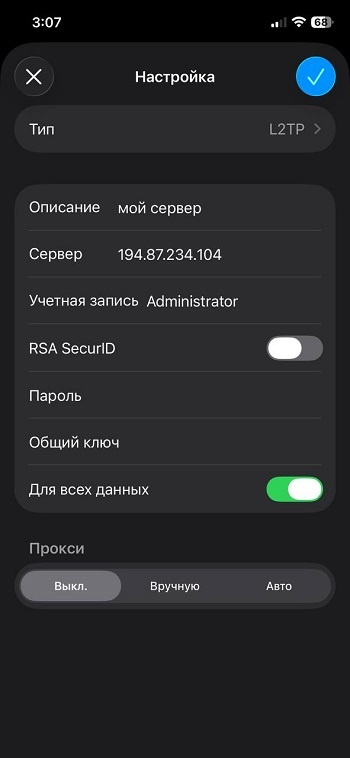

Как подключиться на iPhone

Чтобы подключиться к серверу на iOS (у нас версия 26.4.2) нужно перейти в «Настройки» — «Основные» — «VPN и управление устройством» — «VPN» — «Добавить конфигурацию VPN». После чего мы попадём сюда:

Выбираем тип L2TP и вводим данные, которые записали ранее.

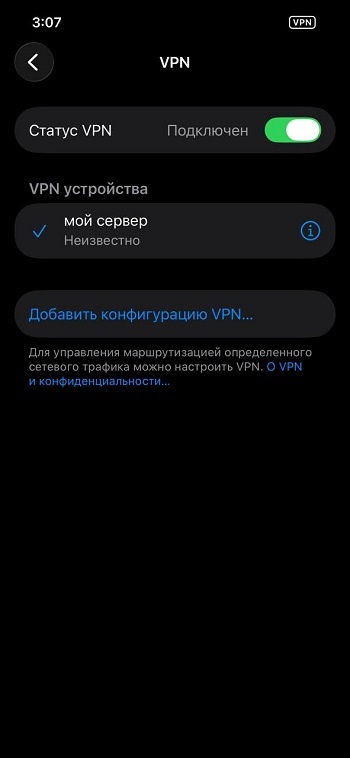

Сохраняем изменения и активируем переключатель «Статус VPN».

На этом всё, теперь сетевые соединения перенаправляются через сервер, и у нас снова есть доступ к недоступным российским сервисам.

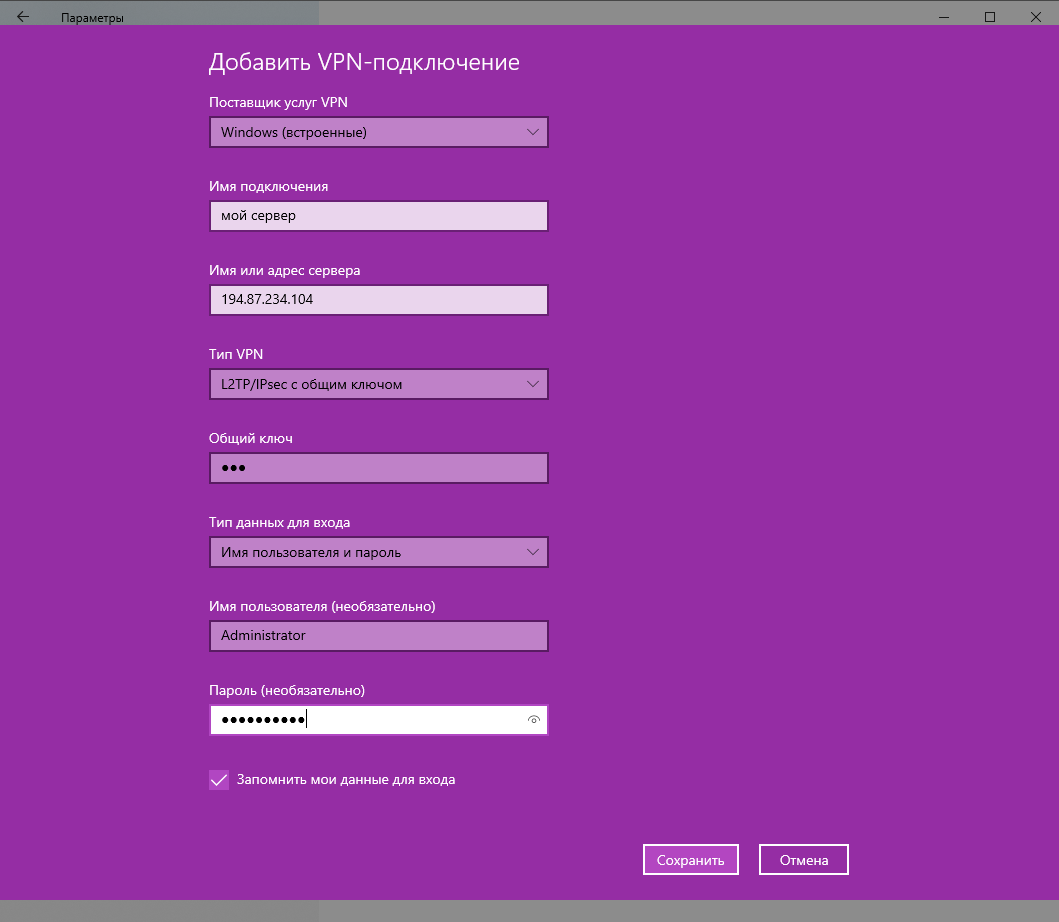

Как подключиться на ПК

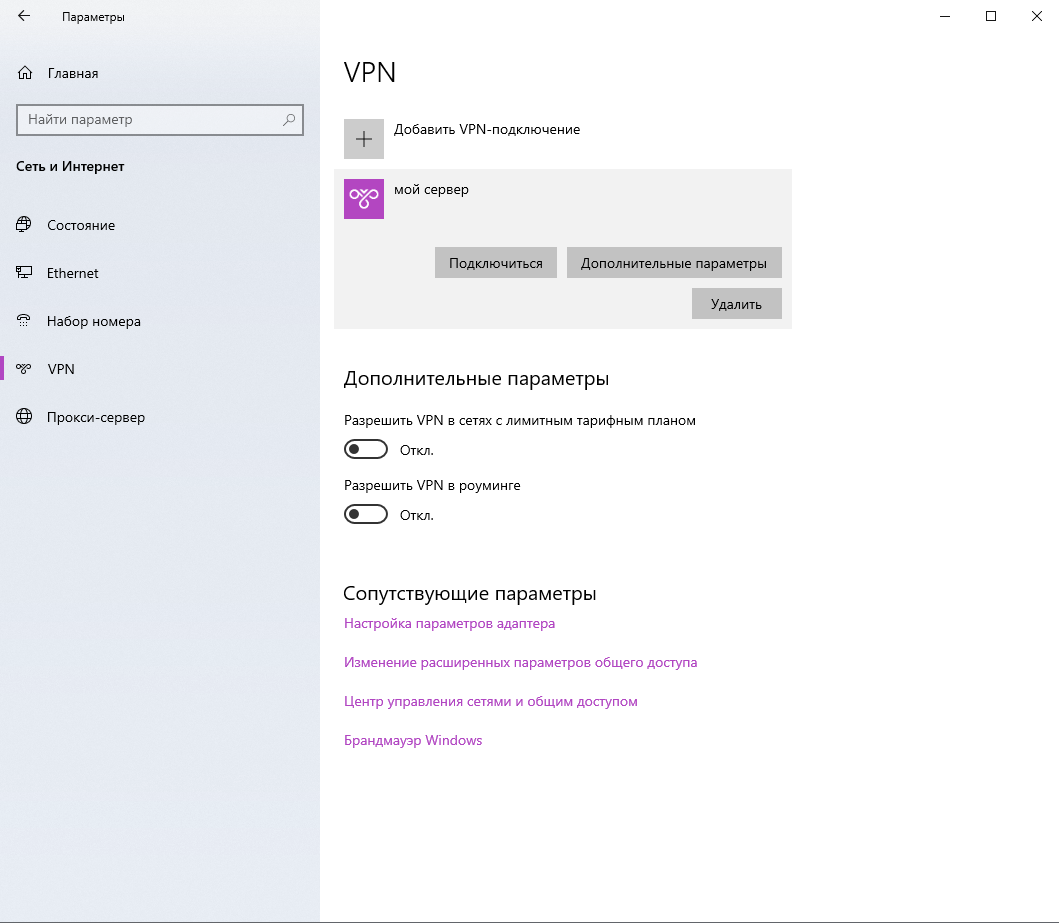

На Windows 10 для подключения нужно перейти в «Пуск» — «Параметры» — «Сеть и Интернет» — «VPN» — «Добавить VPN-подключение».

В следующем окне заполняем те же данные, что и на телефоне:

Сохраняем, и теперь наш VPN появился в предыдущем окне. Подключаемся к нему:

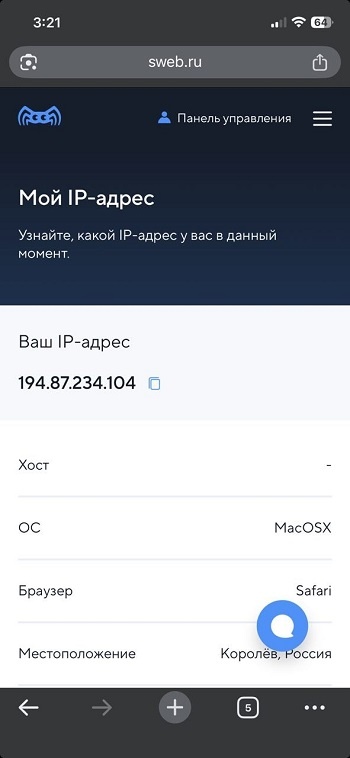

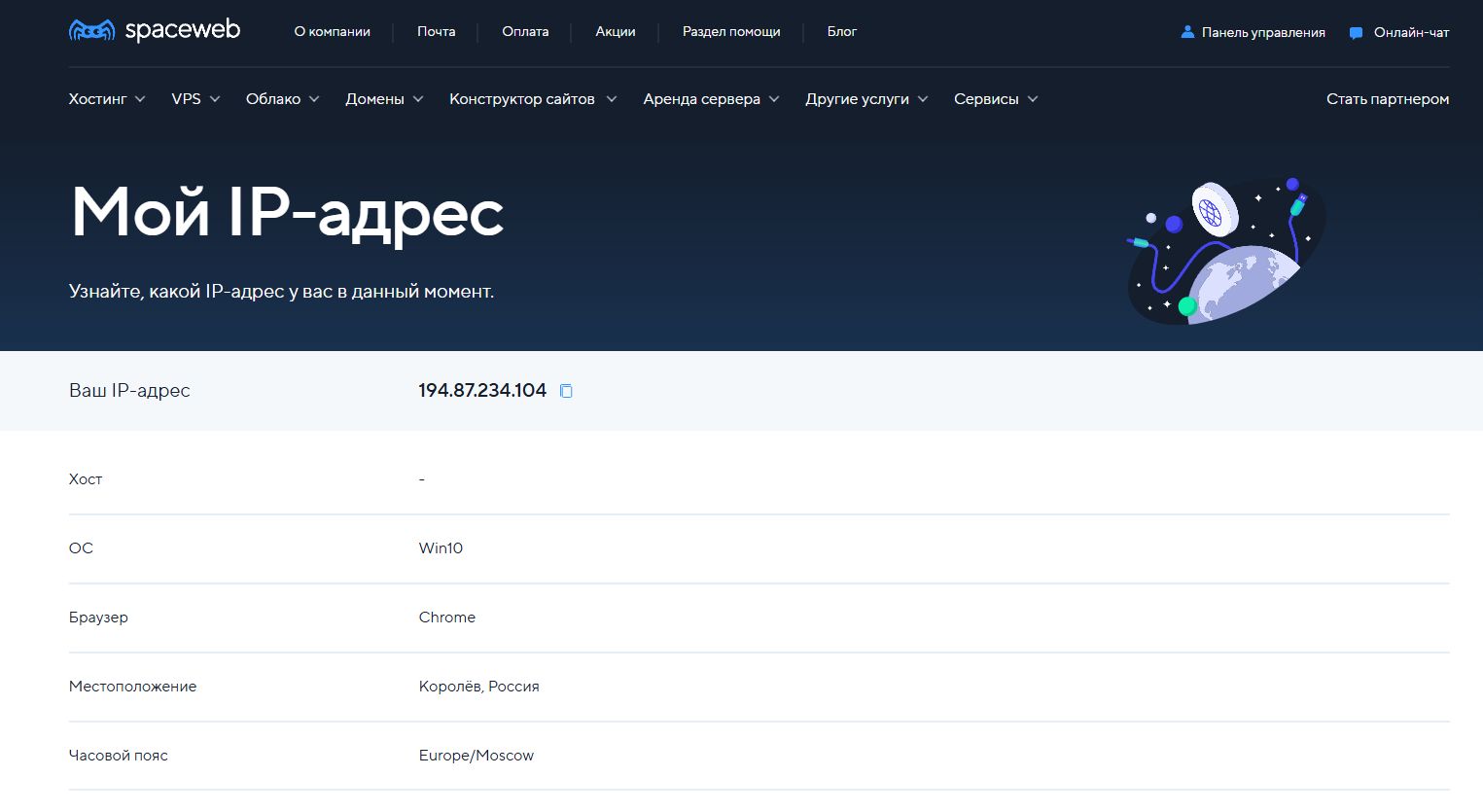

Проверяем — и действительно: подключены через сервер.

Шаблон StrongSwan

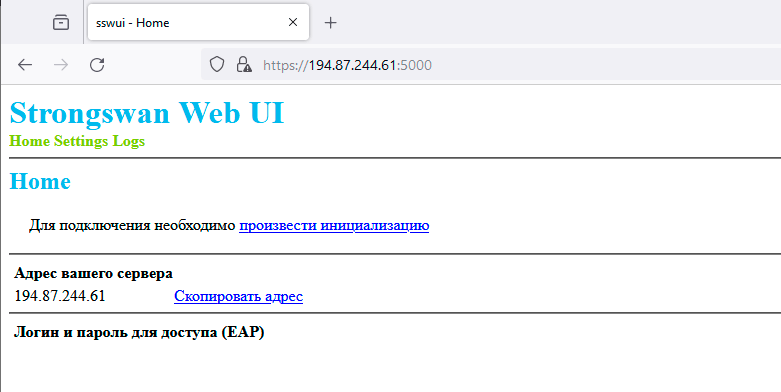

На RUVDS есть ещё шаблон StrongSwan IKEv2/IPSec, о котором мы рассказывали ранее. Он работает примерно как L2TP, только на Linux-сервере.

Образ содержит предустановленный пакет StrongSwan, необходимые зависимости и плагины, а также небольшую утилиту с веб-интерфейсом, которая позволяет выполнить настройку системы и получить необходимые данные для подключения без необходимости заходить по SSH.

IKEv2/IPsec (Internet Key Exchange) — протокол обмена ключами для IPsec. Предназначен для создания защищённых виртуальных частных сетей. В качестве транспорта использует UDP. Обладает крайне важным с точки зрения безопасности свойством PFS (Perfect Forward Secrecy) во всех режимах использования. Это означает, что при компрометации любого ключа в системе (включая долговременные ключи) злоумышленник сможет получить доступ только к части защищаемых данных. Большим преимуществом является возможность добавлять новые функции: около десятка различных расширений было разработано с момента публикации стандарта, и этот процесс продолжается. Сейчас ведутся работы по адаптации IKEv2 к функционированию в условиях существования квантовых компьютеров.

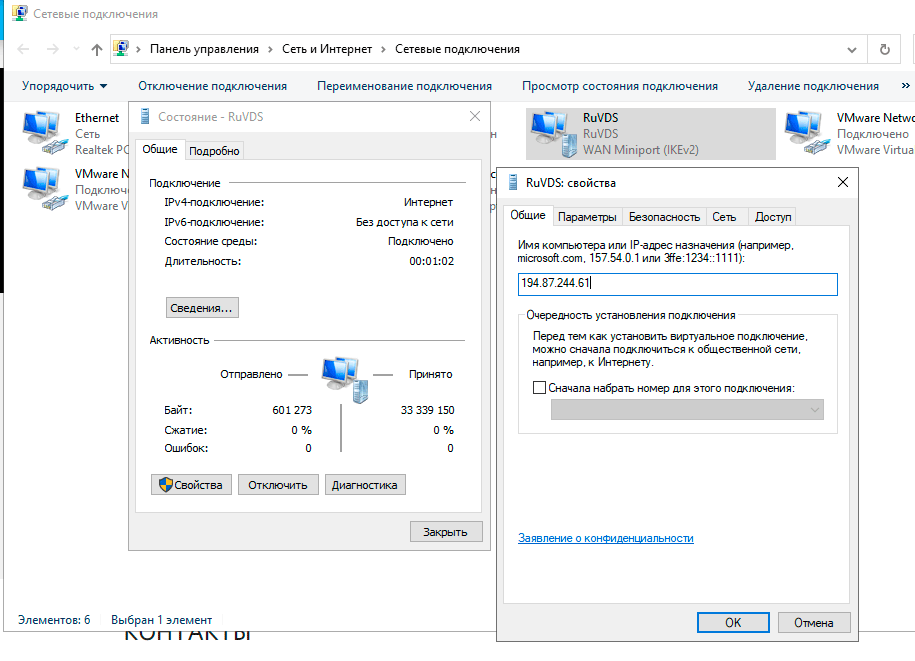

Подключение к серверу со стороны клиента почти ничем не отличается от подключения к L2TP. Например, в Windows прописываем IP-адрес сервера в свойствах сетевого подключения — и работаем через него.

StrongSwan — актуальная, открытая, мультиплатформенная и быстрая реализация IPsec. Проект расширяемый, имеет хорошо масштабируемый многопоточный дизайн, ориентированный прежде всего на IKEv2 и строгую аутентификацию.

Что имеем в итоге

В большинстве случаев данный способ действительно работает и позволяет туристам зайти в банки и другие приложения, так как подключение выполняется через российский IP-адрес. Однако в каждом случае нужно смотреть индивидуально. Ситуация с фильтрацией трафика тоже постоянно меняется. То, что работало вчера, может не заработать сегодня, и наоборот.

Хорошего отдыха!

ruvds.com/ru-rub