Августовский информационный бюллетень OVHcloud

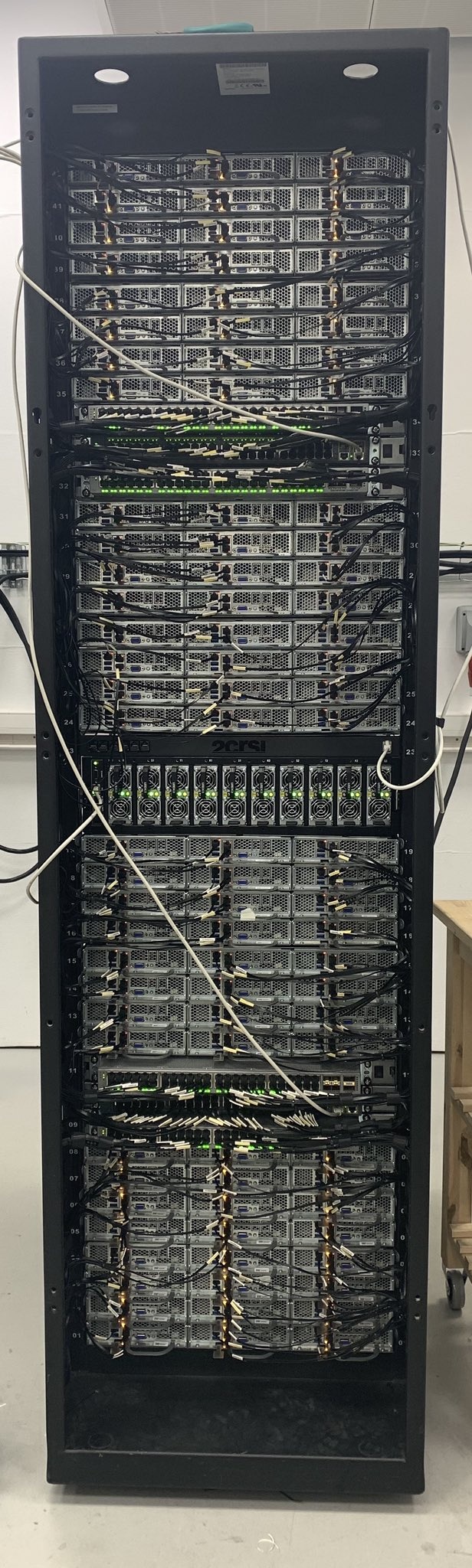

Эффективный и доступный сервер хранения

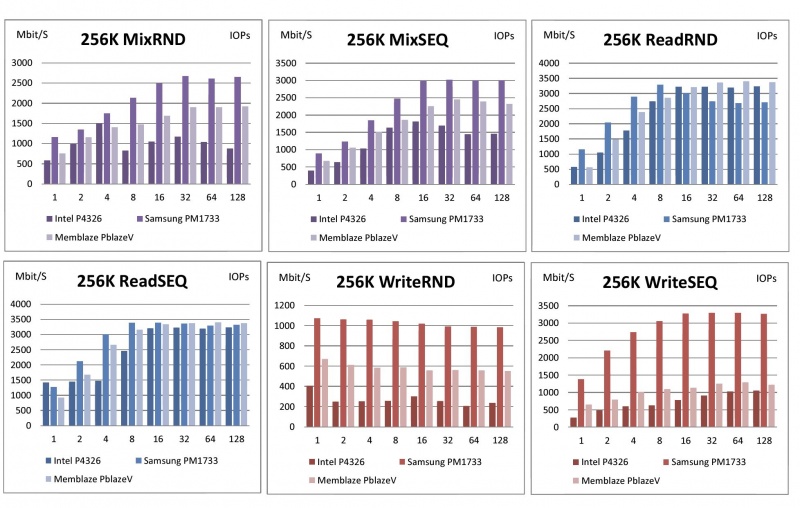

Хранение конфиденциальной информации в больших объемах является абсолютной необходимостью для большинства предприятий в этом климате. Наш сервер Advance-STOR-1 создан специально для таких ситуаций. Этот сервер с 4 жесткими дисками по 4 ТБ SATA и 1 твердотельным накопителем NVMe Soft RAID емкостью 500 ГБ предназначен для хранения конфиденциальной информации и всех ваших мультимедийных файлов, сохраняя при этом весь трафик бесплатным и неограниченным.

Ваш сервер также включает в себя нашу частную сеть vRack, которая позволяет вам безопасно подключать весь спектр продуктов OVHcloud (серверы, облачные экземпляры) Друг к другу, независимо от того, находятся ли они в одном центре обработки данных OVHcloud или в нескольких регионах.

us.ovhcloud.com/dedicated-servers/advance/adv-stor-1/

Аварийное восстановление

Резервное копирование и аварийное восстановление имеют решающее значение для обеспечения непрерывности бизнеса. Быть подготовленным — значит иметь твердый план, который защитит ваши системы от любых непредвиденных обстоятельств, в том числе от ураганов.

Общий принцип аварийного восстановления заключается в том, чтобы ваши системы оставались безопасными, избыточными и гибкими, чтобы предотвратить любое прерывание обслуживания.

Загляните в наш последний блог чтобы узнать, как защитить ваши системы.

us.ovhcloud.com/resources/blog/hosted-private-cloud-hpc-backup-and-disaster-recovery