С Днем Победы!

Сегодня мы отмечаем 75-ю годовщину Великой Победы — праздник, который навсегда в наших сердцах и памяти, несмотря ни на что.

C Днем Победы!

В честь этой знаменательной даты, мы также хотели бы анонсировать скидки до 50%, которые будут действовать только один день — 9 мая!

Веб-хостинг (виртуальный хостинг) — 50%

Виртуальные серверы (VPS/VDS) — 20%

Скидка действует на заказ любой новой услуги.

https://my.msk.host

С Днём Победы!

Уважаемые клиенты!!!

Примите тёплые и сердечные поздравления с самым торжественным праздником – Днём великой Победы!

В этот праздничный день хотим пожелать всем ветеранам крепкого здоровья, долголетия и счастья, а всем нашим клиентам – мира, добра и семейного благополучия.

Только до конца мая, кроме поздравлений и пожеланий, мы дарим Вам подарки. Получите скидку на любой тариф хостинга 50 % при заказе на один месяц. Всё что от вас требуется — это ввести промо-код 9may при оплате тарифа — hostiman.ru/hosting

Поспешите! Акция действительна только для новых заказов.

С уважением, Ваш хостинг-провайдер HostiMan.

Примите тёплые и сердечные поздравления с самым торжественным праздником – Днём великой Победы!

В этот праздничный день хотим пожелать всем ветеранам крепкого здоровья, долголетия и счастья, а всем нашим клиентам – мира, добра и семейного благополучия.

Только до конца мая, кроме поздравлений и пожеланий, мы дарим Вам подарки. Получите скидку на любой тариф хостинга 50 % при заказе на один месяц. Всё что от вас требуется — это ввести промо-код 9may при оплате тарифа — hostiman.ru/hosting

Поспешите! Акция действительна только для новых заказов.

С уважением, Ваш хостинг-провайдер HostiMan.

Новая локация ММТС-9 (Москва)

Представляем Вашему вниманию новейшую локацию ММТС-9. Дата-центр располагается в самом центре Москвы, в круглосуточно охраняемом помещении, а местоположение позволяет достичь наиболее минимального пинга среди игроков из стран СНГ.

Каждый сервер включает в себя специальную игровую Anti-DDos защиту, не требующую дополнительной настройки. Защита предоставляется от нашего партнера ServicePipe на всех уровнях, начиная от L3-L4 и заканчивая L7 фильтрацией для игр и веб-приложений.

На данный момент доступны процессоры на базе Intel i7-8700, имеющие при себе высокоскоростные SSD накопители.

Intel Core I7-8700 (4.6GHz) 1 vCore / 2 GB DDR4 / 25 GB SSD — 350 рубл.

Intel Core I7-8700 (4.6GHz) 2 vCore / 4 GB DDR4 / 50 GB SSD — 700 рубл.

Intel Core I7-8700 (4.6GHz) 3 vCore / 8 GB DDR4 / 75 GB SSD — 1400 рубл.

Intel Core I7-8700 (4.6GHz) 4 vCore / 12 GB DDR4 / 100 GB SSD — 2100 рубл.

Intel Core I7-8700 (4.6GHz) 6 vCore / 16 GB DDR4 / 125 GB SSD — 2800 рубл.

Контакты для связи:

Email: support@spacecore.pro

Telegram: @spacecore_pro

VK: vk.com/spacecore_pro

Биллинг: billing.spacecore.pro

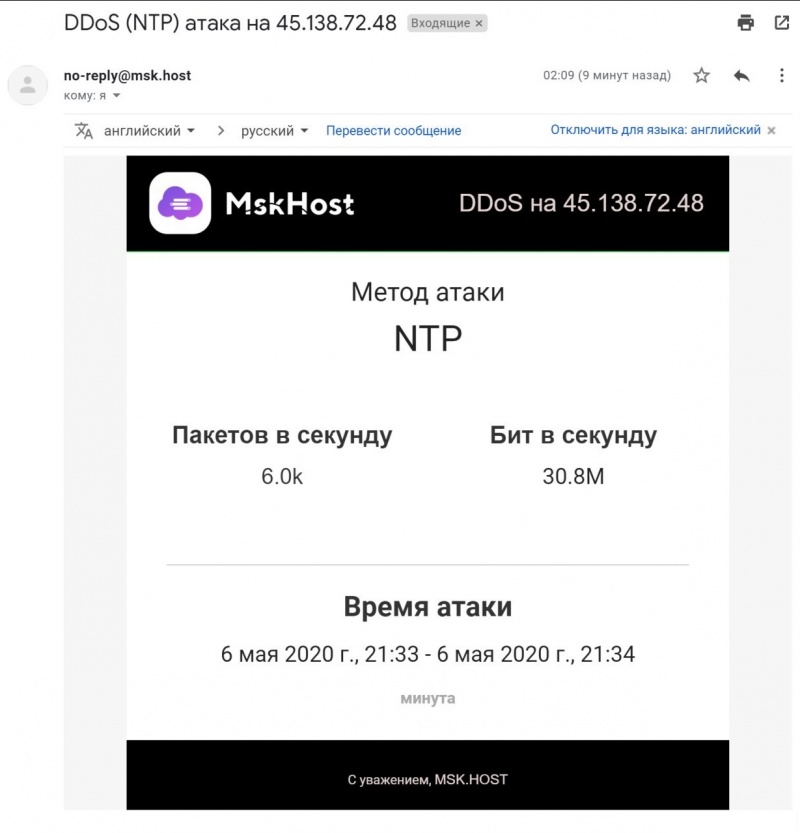

Уведомления о DDoS-атаках

Дорогие друзья!

Рады сообщить, что бета тестирование уведомлений о DDoS-атаках успешно окончено. Теперь уведомления о DDoS подключить можно в личном кабинете, в разделе «Конфигурация», все это происходит в автоматическом режиме.

В ближайшем времени также будет добавлена возможность получения уведомлений во ВКонтакте и Telegram.

Наш сайт: msk.host

Вечный безлимитный веб-хостинг

Лучший безлимитный хостинг (мы) запускает новый (лучший и опять же безлимитный) вечный тариф.

Не хочешь платить каждый месяц или не уверен в стабильности своих доходов? Оплати один раз и забудь на всю жизнь. Пользуйся хостингом, пока интернет существует.

Всего за 699 рублей!

Наш телеграм: Bomjarga & CHSW.group

Группа ВК: BOMJAR.ga

Будем признательны, если Вы оставите свой отзыв:

ru.trustpilot.com/review/bomjar.ga

Не хочешь платить каждый месяц или не уверен в стабильности своих доходов? Оплати один раз и забудь на всю жизнь. Пользуйся хостингом, пока интернет существует.

Всего за 699 рублей!

Наш телеграм: Bomjarga & CHSW.group

Группа ВК: BOMJAR.ga

Будем признательны, если Вы оставите свой отзыв:

ru.trustpilot.com/review/bomjar.ga

NEW: S3 Совместимые интерфейсы для B2 Cloud Storage

Еще в 2015 году мы продолжали слышать один и тот же запрос. Это пошло что-то вроде: «Я люблю ваше обслуживание компьютера резервного копирования, но я также необходимо место для хранения данных по другим причинам-резервное копирование серверов, хостинг файлов, а также создания приложений. Можете ли вы дать мне прямой доступ к вашей памяти?» Мы слушали, и мы построили Backblaze B2 Cloud Storage.

Я горжусь и поражен ответом с тех пор. Только за последние два года, у нас были клиенты доверяют нам больше данных, чем они имели в целом наше первое десятилетие. Эти люди и компании используют B2 Cloud Storage в более чем 160 странах, и мы храним над Эксабайтом своих данных.

И сегодня я очень рад объявить о запуске нашей самой запрашиваемой функции: S3 Совместимые интерфейсы для B2 Cloud Storage. Он доступен сразу же, как публичная бета-версия.

Это означает, что теперь вы можете мгновенно использовать Backblaze B2 Cloud Storage, делая немного больше, чем указывать свои данные в новый пункт назначения. У нас есть ряд партнеров, запуск с нами сегодня, используя этот новый API (такие как IBM Aspera, Quantum, и Veeam). Используете ли вы один из этих инструментов или другой S3 Совместимого решения, нет необходимости писать новый код, никаких изменений в рабочем процессе, и без простоев.

Я написал сообщение в блоге, чтобы предоставить более подробную информацию о том, что это выпущенном сегодня. Будем надеяться, что мы можем помочь вам найти все, что «следующая правильная вещь» для вас.

www.backblaze.com/b2/cloud-storage-pricing.html

Покоряем Дальний восток - Гонконг теперь доступен для заказа.

Наша география расширяется: шестой страной, в которой размещены серверы PQ, стал Китай. А точнее – Гонконг. Нашим партнером в этой стране стал дата-центр уровня Tier III+ компании HKBN, одного из местных лидеров по предоставлению услуг связи.

Как и в остальных странах, в Гонконге мы используем исключительно собственное оборудование, арендуя только «парковочные места» в дата-центре. Кроме того, наши серверы напрямую подключены к точке обмена трафиком Hong Kong Internet Exchange, что обеспечивает более высокую скорость соединения.

Мы продолжаем расширяться и развиваться для вас. Следите за нашими новостями!

pq.hosting

Лучшая защита от опасностей. Делимся особенностями защиты от DDoS-атак

Мы не учитываем вредоносных ботов — принимаем во внимание только реальных посетителей.

Защищаем от угроз на транспортном, сетевом и уровне приложений/сайтов.

Мы оперативно активируем сервер и незамедлительно окажем бесплатную помощь с его настройкой.

Защищаем от атак на 2, 3, 4 и 7-м уровне OSI — 100% всех известных атак.

Защищаем сервер целиком: все Ваши проекты и сервисы будут в безопасности.

Для защиты серверов и сервисов от атак предлагаем решение на основе технологии VAC.

Подробнее читайте на нашем сайте и закажите защиту уже сейчас: zomro.com/anti-ddos.html

New dedicated root servers and Hetzner Cloud with AMD CPUs ++ Secure tool for video conferencing

NEW AX61-NVMe

Опыт впечатляющей производительности AMD Ryzen 9 3900 в нашем новом AX61-NVMe Выделенной Корневой сервера. Его 12 ядер и 24 поток будут сделать быструю работу любых проектов вы с высоко параллельными потоками или требующими вычислительными процессами. Мы смонтировали базовую модель с двумя 1,92 ТБ центров обработки данных NVMe твердотельных накопителей, что повысит ваши скорости чтения / записи. В AX61-NVMe в 128 Гбайт ECC RAM может обнаружить и исправить ошибки и обеспечить повышенную надежность и целостность данных.

В целом, эта модель идеально подходит для виртуализации, редактирования видео, кодирования и других вариантов использования с высокими требованиями к оперативной памяти.

Мощное выступление AX61-NVMe находится в пределах вашей досягаемости для всего € 84 в месяц и установка платы в единовременном € 89.

Вам нужно больше места для хранения? Нет проблем! Это легко добавить до двух SATA / NVMe SSD-накопителей или жестких дисков за небольшую ежемесячную плату, используя наш конфигуратор.

www.hetzner.com/dedicated-rootserver/ax61-nvme/configurator

HETZNER CLOUD: ТЕПЕРЬ ЕЩЕ EPYC С AMD'S CPU

Мы только расширили линейку облачных серверов: начиная с сегодняшнего дня, вы можете развертывать экземпляры с многопоточной производительности процессоров в Риме EPYC второго поколения от AMD!

Эти пакеты Hetzner Облака предназначены для обработки особенно тяжелых нагрузок, даже при постоянном использовании. Повышение производительности, что вы будете видеть хорошо стоит цена.

Всего за € 3,49 в месяц, вы можете раскрутить стартер экземпляра CPX11, который имеет 2 виртуальных процессоров, 2 ГБ оперативной памяти и 40 ГБ SSD NVMe. Или просто € 49.90 в месяц, вы можете развернуть самый большой экземпляр в этой линии, которая имеет 16 виртуальных процессоров, 32 Гб оперативной памяти и 360 ГБ SSD NVMe.

Естественно, что эти сервера EPYC Hetzner Облако также доступны на наших почасовых ставках. И вся наша CPX Облако линейка включает в себя все из множества HETZNER Облака функций, которые наша команда постоянно расширяются.

www.hetzner.com/cloud#pricing

DX181 С EPYC ИСПОЛНЕНИЯ ДЛЯ СЛОЖНЫХ рабочих нагрузок

Торговая марка Dell славится своей надежностью. Объедините это с удивительной производительностью второго поколения AMD EPYC, и у вас есть мощный сервер, который готов приступить к делу.

DX181 Выделенный сервер Dell Root EMC PowerEdge R6515 специально построен для процессора EPYC 7502P с архитектурой Zen2. Этот процессор имеет 32 ядер и 64 потоков, что делает его идеальным для широкого круга случаев применения, особенно те, которые требуют крупномасштабной виртуализации, гипер-конвергентной инфраструктуры, а также сетевые функции виртуализации.

Вы выгоду от универсальности и гибкости этой эффективной модели. Вы можете добавить до 10 дисков в базовую конфигурацию. (Из этих 10 дисков, до 10 может быть NVMe SSD, и до 8 может быть SATA SSD.) Базовая конфигурация поставляется с 128 ГБ DDR4 ECC RAM. Вы можете увеличить это до максимума 512 Гб с использованием приращений 32 ГБ.

Запускается база конфигурации в € 189 в месяц плюс плата установки одноразовая из € 189. Вы можете использовать наш конфигуратор, чтобы увидеть месячную цену вашей идеальной конфигурации.

www.hetzner.com/dedicated-rootserver/dell/dx181/configurator

NEW IMAGE: UBUNTU 20.04 LTS (FOCAL FOSSA)

Релиз Ubuntu 20.04

Недавно мы добавили новый образ для использования на облачных серверах: Ubuntu 20.04 LTS (Focal Фосса). В скором времени также будут доступны для вас, чтобы установить на своих выделенных корневых серверов.

Focal Фосса является одним из долгосрочных выпусков Ubuntu и поставляется с увеличенным сроком поддержки пяти лет.

Важные изменения в новой версии включают поддержку AMD защищённых виртуализации, улучшенную поддержку ZFS, а также опущение Python 2. Кроме того, Ubuntu 20.04 использует новый и быстрый протокол Wireguard VPN.

УЯЗВИМОСТЕЙ БЕЗОПАСНОСТИ НА DELL'S Идрак

Уязвимость была обнаружена на прошивке Идрак Dell. Dell уже сделал патч доступен для всех пользователей. Ниже вы можете увидеть затрагиваемые версии Идрака и версию микропрограммы с разрешением безопасности.

Идрак Идрак версия прошивки

- iDRAC9 4.00.00.00

- iDRAC8 2.70.70.70

- iDRAC7 2.65.65.65

Для получения дополнительной информации, прочитайте эту статью на веб — сайте компании Dell.

www.dell.com/support/article/ru-ru/sln320717/dsa-2020-063-idrac-buffer-overflow-vulnerability?lang=en

ОБЩИЙ ВНЕШНИЙ ПОЛОСЫ увеличена до 7,26 Тбит / S

Обзор все наш равнозначные, транзиты и частных peerings

Мы постоянно увеличиваем общую внешнюю полосу пропускания для Вас. Следующие выше по потоку были расширены или в эксплуатацию:

Частные peerings:

- 140 Гбит / с Мегафон (FRA)

- 100 Гбит / с RETN (FRA)

- 40 Гбит / с TalkTalk (LON)

- 20 Гбит / с Телиной (FRA)

Учебник: SECURE видеоконференцсвязи с JITSI РОЛИК

Многие люди ищут безопасный инструмент видеоконференций, который не имеет лазеек безопасности или проблемы с подключением.

Jitsi Знакомства это бесплатное решение с открытым исходным кодом и предоставляет Вам высокое качество, безопасной и масштабируемой связи.

Вы хотите использовать Jitsi Meet на сервере?

Там это шаг за шагом учебник на странице сообщества, который показывает вам, как вы можете установить Jitsi Meet для Debian или Ubuntu.

community.hetzner.com/tutorials/jitsi-meet-on-debian-ubuntu