20 и 21 сентября 2021 года в Санкт-Петербурге прошла профессиональная конференция разработчиков высоконагруженных систем Saint Highload ++, в которой мы приняли участие в качестве Серебряного партнёра.

Два дня отвечали на вопросы о мощном «железе» и свежих процессорах, общались с гостями и спикерами конференции, а чтобы запомниться посетителям — прикатили на свой стенд настоящий Harley-Davidson и устроили байкерскую войну с захватом территорий.

сновная задача заключалась в том, чтобы повысить узнаваемость бренда за счёт вовлечения как можно большего количества участников конференции в наши активности. Для этого нам нужно было определиться как минимум с тремя моментами:

- интересная концепция и оформление стенда,

- механика активности — простая, но не примитивная,

- и мотивационная составляющая, которая будет отвечать за желание людей влиться в интерактив.

Концепция родилась на одном из общих мозговых штурмов, когда мы искали яркие идеи-ассоциации на темы, связанные с нашим основным направлением — выделенными серверами. Железо, гибкость конфигураций, возможность относительной кастомизации, выбор процессоров — работа коллективного сознания началась с металла и хард-рока, а в итоге привела нас к мотоциклам, духу свободы и байкерам. Тут же было решено оформить стенд в стиле байкерского клуба — кирпичная стена, барная стойка, флаги… Ну и какая же байкерская сходка без мотоцикла? Реальный Harley-Davidson.

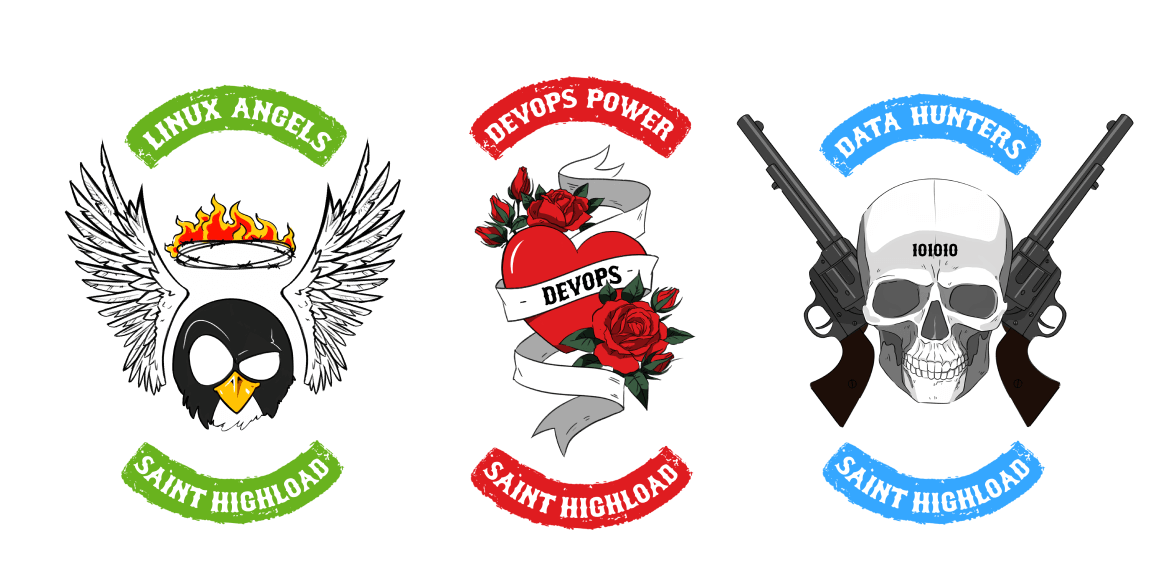

Вдохновившись сериалом «Сыны Анархии», мы выбрали название, дизайн одежды для стендистов и поехали на конференцию как «Сыны нагрузки» или в нашем случае — Sons of Highload.

Механику активности связали с концепцией. Решили, что всё должно быть по-взрослому — эмблемы клубов, перестрелки, война за влияние над территориями. Принять участие в игре мог любой участник выставки, было бы желание.

А желание было. И у многих. Ведь каждый, кто принимал правила игры и проходил все задания, автоматически становился участником розыгрыша и мог побороться за главный приз — MacBook. Вот и

мотивация подъехала.

Как проходила игра

Каждый желающий должен был вступить в одну из трёх банд — Linux Angels, Devops Power или Data Hunters.

И получить от нас

специальный бейдж участника с уникальным номером и бандану как знак, который помогает отличать своих от чужих.

Теперь новоиспеченному байкеру предстояло самое интересное — собрать полный набор наклеек, место под которые было предусмотрено на лицевой стороне бейджа, и подтвердить право на

членство в байкерском клубе на участие в розыгрыше.

Первую наклейку

Первую наклейку, или верхний рокер, участник получал сразу — вместе с бейджем и банданой.

Вторую, нижний рокер, мы давали за перестрелку. Для этого участнику выдавалось четыре наклейки-пули цвета своей банды — зелёного, красного или синего. Задача заключалась в том, чтобы обменять эти пули на пули других банд. Например, четыре синие «пули» обменять на две красные и две зеленые. Наклеить на бейдж и вернуться с почётным званием ветерана перестрелки на стенд за честно заработанным нижним рокером.

Третья наклейка

Третья наклейка, самая главная — эмблема банды, требовала от участника больше всего усилий. Чтобы получить её, нужно было принять участие в захвате территорий.

Для этого мы поделили пространство, где проходило мероприятие, на зоны. За каждым стендом закрепили точку захвата — всего получилось 7 зон, 12 точек. Задание считалось выполненным, если участник захватывал минимум 9 точек из 12.

Также, чтобы все проходило прозрачно и честно для участников, мы разработали специальный сервис. Нам он помогал вести учёт игроков и отслеживать как личный прогресс каждого игрока, так и общий прогресс команд. А игроки с его помощью могли с собственного телефона проводить захват территорий и видеть, сколько точек ими захвачено.

Для этого участник сканировал уникальный QR-код на обратной стороне своего бейджа, проходил авторизацию и регистрацию. После чего ему открывалась карта конференции, соответствующая реальному расположению стендов.

Выглядела она так:

Для захвата конкретной точки участнику требовалось кликнуть по ней на карте, а затем загрузить в открывшееся окно селфи на фоне стенда, который ей соответствует.

Но не всё так просто. Фото нужно было сделать так, чтобы хорошо было видно лицо участника, его бейдж и название стенда.

Для удобства участников описания заданий были доступны по ссылке на обратной стороне бейджа, а карта захвата транслировалась на большом экране на нашем стенде. Это помогало бандам следить за прогрессом игры и понимать, какая из них лидирует в захвате территорий в данный момент — каждая зона перекрашивалась в цвет банды, захватившей ее.

Помимо основных заданий, были ещё и дополнительные. Выполняя их, участники могли получить от нас корпоративный мерч, например, футболку, или больше шансов на выигрыш главного приза.

Так, по условиям нашей игры, все участники банды, которая победит в войне за территории, должны были получить плюс 1 шанс на выигрыш в розыгрыше MacBook Air.

Также мы поощряли участников за рекрутинг новых кандидатов в банды, победу в игре «Камень-ножницы-бумага» с нашими стендинстами, селфи с известным блогером Wylsacom, за ответы в квизе и многие другие задания.

Основные задания можно было выполнять в любом порядке, как душа пожелает. Главное, успеть до розыгрыша собрать все наклейки на бейдж. В дополнительных выигрывал тот, кто успевал в числе первых пяти выполнить задание.

Розыгрыш

Примерно за 30 минут до старта розыгрыша мы завершили войну банд и подвели итоги — команда красных захватила все территории и все члены команды Devops Power получили плюс 1 обещанный шанс.

Также мы оповестили всех участников игры с помощью телеграм-бота, что скоро начнем разыгрывать призы.

Во время игры мы использовали бота для того, чтобы подогреть интерес игроков — могли отправлять игрокам задания или рассказывать о том, как идет битва за территории, чтобы отстающие вовремя мобилизовались. А после игры и розыгрыша — чтобы связаться с теми, кто не смог сразу получить свой приз. Поскольку розыгрыш проводился среди всех выполнивших задания, а не только тех, кто пришёл вовремя к сцене.

Самым удачливым достались наши рюкзаки, брендированные диски и, конечно, главный приз — MacBook.

Итоги

Итоги

Мы получили много позитивных отзывов от участников игры, которые приходили на стенд, говорили, что это было круто и здорово. Но самым интересным оказалось то, что наши активности оценили даже те, кто в них не участвовал. Например, партнёры конференции, которым мы увеличили трафик посещаемости на стендах. Заинтересовавшись, что это вообще за движуха такая — бейджи, люди в банданах, прибегающие фотографироваться, разговоры про перестрелки, они приходили к нам на стенд с вопросами, что происходит, а потом ещё и благодарили за то, что мы отправляли к ним народ.

В итоге в розыгрыше приняло участие около двухсот человек, наши банданы мелькают до сих пор на фото тех, кто побывал на конференции, а мы в ближайшее время начинаем подготовку к следующему мероприятию. Хотите драйва и впечатлений, ждите нас в ноябре на Highload++ 2021 в Москве.

А пока можете зарядиться атмосферой прошедшей конференции и полистать фото.

Источник фото:

vk.com/highloadconference