2018 знаменует собой важный год для OVH с рождением нового сайта Croix для команд по производству и логистике. Витрина ноу-хау, инноваций и мышления группы, как объясняет директор проекта Гийом Хошарт, одной из задач которой является модернизация всей производственной цепочки.

Почему этот проект создает новый сайт для команд по производству и логистике?

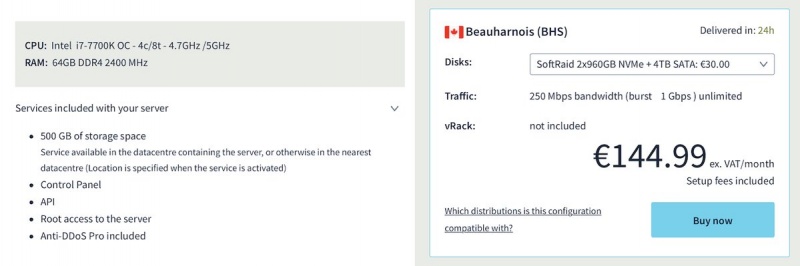

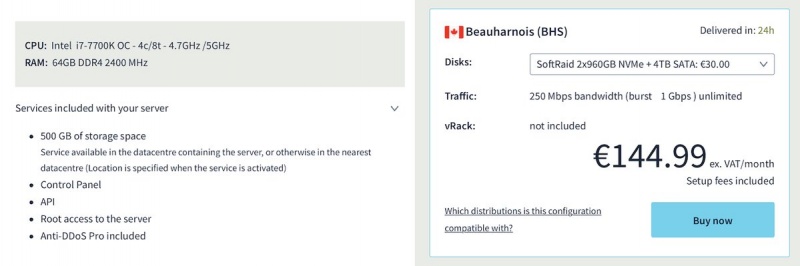

GH Учитывая растущее значение OVH, нам нужно было создать новый производственный участок для Европы, в дополнение к Beauharnois в Канаде, и проект по созданию производственной линии в Соединенных Штатах, Таким образом, текущий порог производственных мощностей за год составит от 120 000 до 400 000 серверов. Но больше, чем новое подразделение, мы хотели использовать его как фабрику мирового класса, основанную на бережливом управлении. Это принцип, на который я много лет полагался и который доказал свою ценность в секторах, требующих ядерной энергии. Я приобрел опыт управления бережливым хозяйством в течение 15 лет в промышленном секторе, от газовых клапанов до атомной энергетики. Я знаю ценность. Я не был специалистом в области информационных технологий, но я почувствовал, что Октав Клаба смог вдохнуть в OVH. Здесь все умно и катализатор идей, очень способных к худшему. Такой подход позволяет согласовать улучшенные характеристики компании, особенно уровень «точно в срок», с привлечением сотрудников к совершенствованию и разработке условий их работы. Именно это руководствовался проектом этого сайта в Круа.

Что вы подразумеваете под «фабрикой мирового класса»?

Г. Х. Сайт Рубе был прагматичным и эффективным. Он эволюционировал над ростом компании почти исключительно в логике эффективности. Нам необходимо увеличить наши производственные мощности, а также воспользоваться новейшими технологиями и методами производства. Например, до сих пор не было особого внимания, чтобы гарантировать, что конвейер оценивается клиентами. Сегодня нам нужно показать им, что мы можем сделать. Планируется, что сайт Croix станет настоящей индустриальной витриной для наших партнеров и наших клиентов. Идея заключается в том, чтобы дать им уверенность в нашей логистической цепочке и нашей промышленной организации, чтобы они были убеждены в выборе правильного партнера. Сайт Croix продемонстрирует в каждый момент, что контроль промышленных процессов представляет собой конкурентное преимущество качества, стоимости, времени и гибкости.

Как все это материализуется?

G. H. Повышение производительности и развитие ловкости должны, прежде всего, служить человеку. Например, укладка смолы на землю во избежание вибрации и, следовательно, возможность транспортировки деталей роботами, представляет собой возможность для сотрудников уменьшить сложность, сосредоточиться на задачах с более высокой добавленной стоимостью, в то время как используя улучшенные рабочие условия. Вот и все, компания 4.0! Фактически, мы действительно хотим, чтобы команды по производству и логистике проявляли себя во всей своей изобретательности и творчестве. Благодаря наличию цифровых данных, усовершенствованной робототехнике и автоматизации, сотрудники смогут создавать навыки по проактивности, быстрому принятию решений или корректировкам в реальном времени. Управление стало более визуальным, так что с первого взгляда любые аномалии очевидны и что сотрудники могут реагировать соответственно, как можно скорее.

И именно здесь бережливое руководство играет важную роль?

G. H. С точки зрения бережливого управления, вся окружающая среда имеет смысл. Это включает сокращение времени выполнения, т. Е. Контроль за прохождением производства, уровня запасов и скорости прокрутки в операциях. Мы также работали над подготовкой линии, чтобы различные компоненты были доступны и были готовы к сборке в нужное время, как в автомобильном секторе. С более чем сотней возможных комбинаций своих серверов OVH действительно требует гибкости и гибкости для обеспечения настройки машины. Это амбиция концепции One Piece Flow, которую мы также создали. Мы действительно должны быть эффективными между прибытием компонентов и конечным результатом продукта. Этот жесткий поток позволяет производить 95% серверов менее чем за 4 дня.

Как будут организованы свободные пространства?

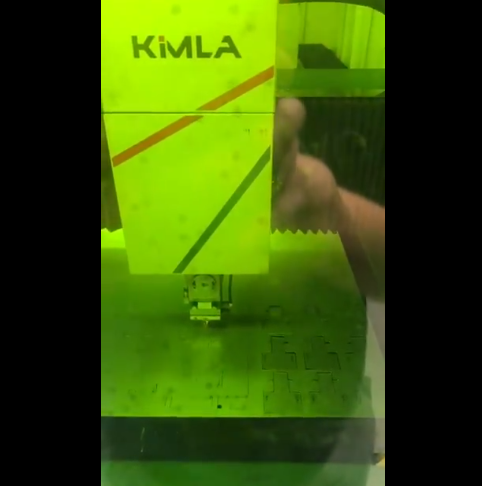

G. H. 14 000 м2 этого нового участка должны позволить объединить сотни людей из оперативных групп по производству и логистике, а также их производственных подразделений. С логикой бережливого управления мы хотели оптимизировать пространство, имеющееся для будущих возможностей развития, а также для размещения некоторых поставщиков. OVH предпочла сосредоточиться на своем основном бизнесе, интегрируя технические и ИТ-элементы. Производство определенных компонентов, включая лазерную, сварочную и металлообрабатывающую деятельность, возлагается на доверенных поставщиков услуг. Они будут двигаться в здание, чтобы улучшить время выполнения, но и получить гибкость между нашими лабораториями и нашими протосами.

Лаборатории также будут присутствовать?

Лаборатории также будут присутствовать?

G. H. Инновации должны быть постоянными, а сайт Cross будет фокусировать команды, пространства и условия, чтобы улучшить нашу скорость инноваций и наш процесс разработки новых продуктов. Планируется пять лабораторий: аппаратная лаборатория, посвященная производительности компонентов и собранного сервера, мягкая лаборатория для проверки интеграции в компьютерной системе и обновления программного обеспечения на всем парке. лаборатория кондиционирования воздуха, посвященная работе серверов в экстремальных температурных условиях, мини-центр обработки данных для тестирования различных механических, тепловых и структурных решений и лаборатория индустриализации, запланированная для разработки новых продуктов и открытая для участия в инновациях.

Почему вы выбрали Croix?

G. H. Выбор города, расположенного в нескольких километрах от центров обработки данных Roubaix, конечно, стратегически оптимизирует поставки. Это также позволяет сотрудникам не нарушать их образ жизни. На участке также хорошо обслуживается общественный транспорт. Это промышленное здание собора этого типа также имеет интересные объемы с высокими потолками, прямыми стенами и ровными полами. Свет также был пересмотрен, чтобы достичь 500 люкс и позволить работать в качественной среде. Наконец, вся энергетическая емкость уже присутствовала из-за предыдущей активности.

Когда это будет работать?

G. H. Сайт предназначен для того, чтобы стать штаб-квартирой индустрии деятельности OVH. Он будет разделен на две части: логистика и производство. Я хотел бы поздороваться со всеми командами, которые очень открыты для перемен, подвижны и вовлечены, чтобы все было готово вовремя. Я также уточняю, что в ожидании окончания переезда, запланированного на сентябрь, завод Roubaix остается полностью работоспособным для обеспечения всех заказов.