Мы работаем в совершенно новом, исключительном контексте, и мы будем делиться тем, что мы делаем в OVHcloud для достижения нашей цели — быть здесь, чтобы помочь, и предоставить вам твердую поддержку, однако долго пандемия продолжается.

Непосредственная адаптация

В течение нескольких дней мы адаптировали наши методы работы, с тем чтобы гарантировать Вам непрерывность обслуживания, и поддерживать вас в наилучших условиях, защищая наши сотрудник. Это означает:

Наши команды работают из дома.

За несколько дней, около 2000 сотрудников перешли на удаленную работу, начиная с поддержки клиентов. Наши консультанты будут отвечать как всегда, но из своих домов. Мы хотели бы еще раз поблагодарить вас за ваше терпение и понимание в течение этого переходного периода.

Для всех изо дня в день действий — например, управление вашей учетной записи, адаптируя инфраструктуру, добавляя новые ресурсы и выбирающих новые решения, пожалуйста, попробуйте использовать наши онлайн-сервисы с помощью панели управления OVHcloud.

Тщательные меры профилактики в наших центрах обработки данных

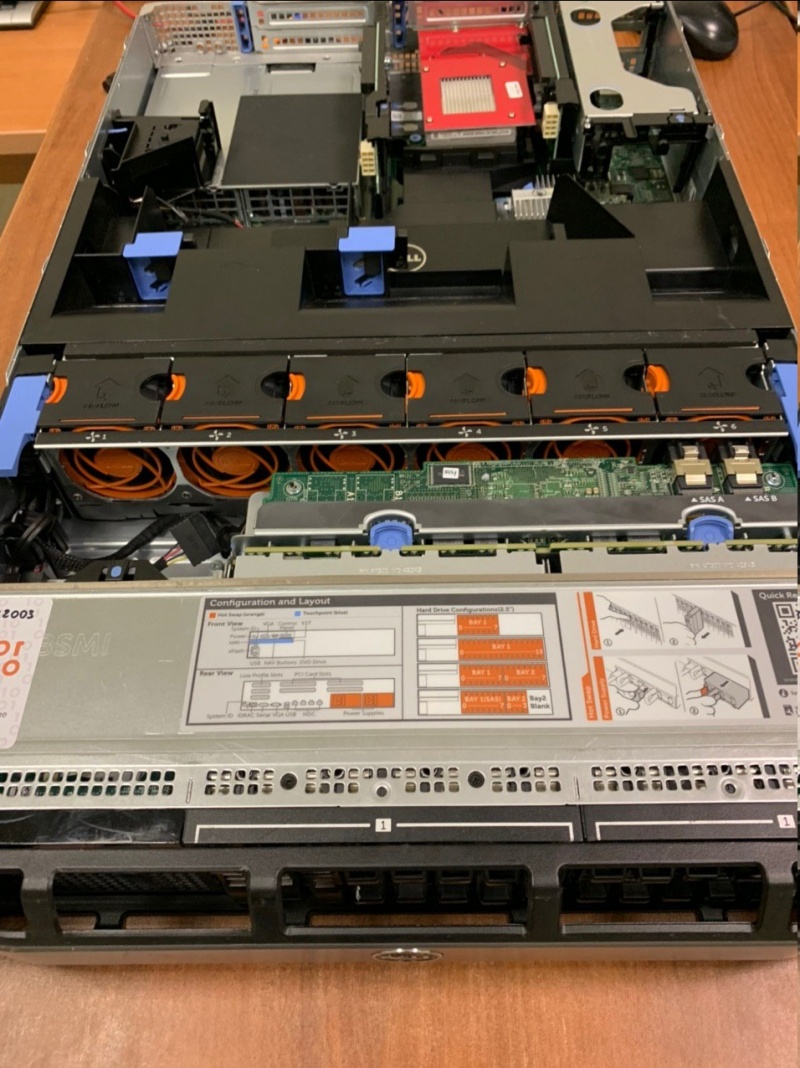

Для того, чтобы гарантировать Вам непрерывность обслуживания, мы резко усилены меры профилактики в наших центрах обработки данных и производственных центров. Эти сайты в настоящее время дезинфицируют 3 раза в день, и мы реорганизовали наши команды, чтобы сохранить взаимодействие к минимуму.

Таким образом, все операции по обслуживанию могут быть выполнены как обычно в наших 30 центров обработки данных, для всех 400000 наших серверов.

Очень строжайшей безопасности для облака

В OVHcloud, безопасность данных всегда была одним из главных приоритетов — как в нашей инфраструктуры, и наша собственная организация. Это текущая ситуация требует от нас быть еще более бдительными, чем обычно, так как злоумышленники могут искать способы использования более широкого использования цифровых технологий в ответ на ловушках мер.

Постоянная предосторожность для OVHcloud:

Ситуация исключительна, но кризис системы мы внедрили, оказалось надежным и хорошо адаптируются. Мы значительно укрепили наш мониторинг и оповещение меры, чтобы обнаружить даже самые тонкие слабые сигналы, которые могут повлиять на уровень безопасности наших услуг.

Кроме того, мы работали над тем, чтобы наша повседневная работа может вести, без каких-либо компромиссов или недостатков в наших мерах безопасности.

Будьте бдительны для систем:

Сейчас более чем когда-либо, настороженность важно действовать от атак, которые могут повлиять на ваши системы и сотрудников. Вот почему важно быть очень внимательным — и помочь вам, наши команды написали сообщение в блоге о лучших практиках для реализации.

В свете массивного всплеска в попытках фишинга, мы хотели бы напомнить вам, что OVHcloud никогда не будет запрашивать ваши банковские реквизиты по электронной почте.

Есть вопросы о влиянии пандемии на ваши услуги? Мы ответим на них здесь.

help.ovhcloud.com/en/

Еще раз спасибо за выбор OVHcloud.

И где бы вы, заботиться о себе и своих любимых.

Команды OVHcloud